Önde gelen politikacılar, akademisyenler, sağlık hizmeti sağlayıcıları, yapay zeka geliştiricileri ve hasta savunucuları, kapalı kapılar ardında düzenlenen çalıştayda sağlık alanında yapay zeka politikasının ileriye dönük yolunu tartışıyor.

15 Temmuz 2024/ Caroline Meinhardt, Alaa Youssef, Rory Thompson, Daniel Zhang, Rohini Kosoglu, Kavita Patel, Curt Langlotz

Yapay Zeka (YZ), tanı doğruluğunu artırarak, idari operasyonları kolaylaştırarak ve hasta katılımını artırarak sağlık hizmeti sunumunu dönüştürme potansiyeline sahiptir. 2017-2021 yılları arasında sağlık sektörü, küresel olarak diğerlerinden daha fazla özel YZ yatırımı aldı.

Bu yeni sağlık teknolojilerine duyulan coşkuya uzun zamandır hasta güvenliği, zararlı önyargılar ve veri güvenliğiyle ilgili endişeler eşlik ediyor. Düzenleyiciler, fiziksel cihazlar, kayıtlar ve analog veriler çağında oluşturulan düzenleyici çerçevelerin kısıtlamaları dahilinde güvenli, adil ve emniyetli makine öğrenimi algoritmalarını korurken bu yenilikçi araçları destekleme zorluğuyla karşı karşıyadır. Yapay zekanın sağlık süreçlerine hızla benimsenmesi, mevcut düzenleyici çerçevelerin gözden geçirilmesi için acil bir ihtiyaç yaratmaktadır.

Bu açığı fark eden Stanford İnsan Merkezli Yapay Zeka Enstitüsü (HAI), Mayıs 2024’te kapalı kapılar ardında bir çalıştay için 55 önde gelen politika yapıcı, bilim insanı, sağlık hizmeti sağlayıcısı, etikçi, yapay zeka geliştiricisi ve hasta savunucusundan oluşan seçkin bir grubu bir araya getirdi.

Toplantı, bu alanlardaki politika ve araştırmaları ilerletmek için çalışan Stanford öğretim üyelerinden oluşan disiplinler arası bir komite olan HAI’nin Sağlık Yapay Zekası Politika Yönlendirme Komitesi tarafından düzenlendi ve temel yapay zeka politika boşluklarını vurgulamak ve düzenleyici değişiklikler için desteği harekete geçirmek için düzenlendi.

HAI Ortak Direktörü Curt Langlotz ile yapılan konu ile ilgili sohbet.

Sağlıkta Yapay Zekayı Nasıl Daha İyi Düzenleyebiliriz?

Chatham House Kuralı uyarınca, katılımcılar federal sağlık hizmeti YZ politikasındaki eksiklikleri üç alanda tartıştılar: Klinik karar desteği için AI yazılımı, sağlık hizmeti kurumsal YZ araçları ve hastaya dönük YZ uygulamaları. Aşağıda, her düzenleyici alan için temel temaları, politika değerlendirmelerini ve katılımcı görüşlerini özetliyoruz.

2024 Yollarında 1976 Chevy Impala Sürmek Gibi

Sağlık, Amerika Birleşik Devletleri’ndeki en sıkı şekilde düzenlenen endüstrilerden biridir. Ve endüstrinin geniş kapsamlı düzenleyici çerçeveleri halihazırda YZ’’ya uygulanmaktadır.

Gıda ve İlaç Dairesi (FDA), yazılımı tıbbi cihaz (SaMD) olarak değerlendiren 510(k) cihaz izni süreci aracılığıyla birçok yazılım sistemi için düzenleyici sorumluluğa sahiptir. İdari ve klinik işletme bağlamlarında kullanılan AI uygulamaları, örneğin algoritmik şeffaflığı zorunlu kılan Ulusal Sağlık Bilgi Teknolojisi Koordinatörü Ofisi’nin kurallarına uymalıdır. Doğrudan tüketiciye yönelik sağlık YZ araçlarının yönetimi, çeşitli tüketici ürünü çerçeveleri kapsamına girmektedir, ancak bu yeni alanda henüz çok az uygulama yapılmıştır.

Bu düzenleyici çerçeveler güncelliğini yitirmiştir. FDA’nın 1976’da kurulan düzenleyici otoritesi, eğitim verilerine dayanan ve titiz sürekli performans izlemesi gerektiren yazılımları değil, donanım cihazlarını düzenlemek için tasarlanmıştır. Benzer şekilde, Sağlık Sigortası Taşınabilirliği ve Hesap Verebilirlik Yasası (HIPAA) – sağlık verilerinin gizliliği ve güvenliği için ulusal standartlar belirleyen 1996 tarihli bir yasa – dijital sağlık bilgilerinin patlamasından öncedir. Hükümleri, makine öğrenimi algoritmalarını eğitmek için çok miktarda hasta kaydına ihtiyaç duyulacağını öngörmemiştir.

Düzenleyiciler, günümüz yol koşullarına uyum sağlamakta zorlanarak 2024 yollarında etkili bir şekilde bir Chevy Impala kullanıyor, bir katılımcının belirttiğine göre.

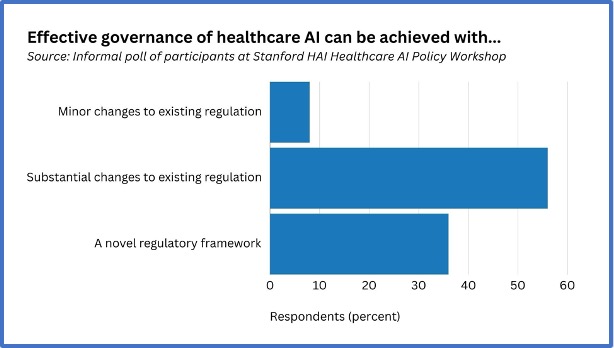

Sağlık hizmetlerindeki geleneksel düzenleyici paradigmaların, hızlı YZ gelişimine sahip bir dünyaya acilen uyum sağlaması gerekiyor. Atölye katılımcılarının büyük çoğunluğu, etkili sağlık YZ yönetimi için yeni veya önemli ölçüde değiştirilmiş bir düzenleyici çerçevenin gerekli olduğuna inanıyor.

Kullanım Örneği 1: Tıbbi Cihaz Olarak Yazılımda Yapay Zeka

Tanı yeteneklerine sahip yeni AI destekli tıbbi cihazlarının geliştiricileri şu anda büyük bir zorlukla karşı karşıyadır: FDA cihaz onay süreci, her bir tanı yeteneği için kanıt sunmalarını gerektiriyor. Göğüs röntgeninde görülebilecek neredeyse tüm anormallikleri tespit edebilen bir algoritma gibi yüzlerce tanı yeteneğine sahip YZ ürünleri için, her birini düzenleyici onay için sunmak ticari olarak uygulanabilir değildir. Bu, küresel yazılım şirketlerinin pazara daha düşük kaliteli, daha az yenilikçi ürünler getirmesine ve ABD YZ tıbbi cihaz inovasyonunu engellemesine neden olabilir.

Çalıştay katılımcıları, klinik güvenliği sağlarken bu çok işlevli yazılım sistemleri için pazar onayını kolaylaştırmaya yardımcı olacak yeni politika yaklaşımları önerdiler. İlk olarak, kamu-özel sektör ortaklıkları, potansiyel olarak pazar sonrası gözetimi ilerletmeye odaklanarak, bu tür onayların kanıt yükünü yönetmek için çok önemli olacaktır. İkinci olarak, katılımcılar cihaz izin süreci sırasında daha iyi bilgi paylaşımını desteklediler. İzin süreci sırasında test verileri ve cihaz performansıyla ilgili ayrıntıların paylaşılması, sağlık hizmeti sağlayıcılarının yazılım araçlarının kendi muayenehanelerinde güvenli bir şekilde çalışıp çalışmayacağını daha iyi değerlendirmelerini sağlayabilir. Yapay zeka veya makine öğrenimi yazılımı içeren yaklaşık 900 tıbbi cihaz FDA tarafından onaylanmış olsa da, sağlık kuruluşlarının satın alma kararlarını dayandıracakları sınırlı bilgiye sahip olması nedeniyle klinik benimseme yavaş olmuştur.

Son olarak, bazı katılımcılar YZ destekli tıbbi cihazlar için daha ayrıntılı risk kategorileri talep ettiler; bunların büyük çoğunluğu şu anda orta riskli Sınıf II cihazlar olarak sınıflandırılıyor. Klinik risk, farklı YZ/makine öğrenimi yazılım cihazları türleri arasında büyük ölçüde farklılık gösterir ve bu da daha özel bir yaklaşım gerektirir.

Kullanım Örneği 2: Kurumsal Klinik Operasyonlar ve Yönetimde Yapay Zeka

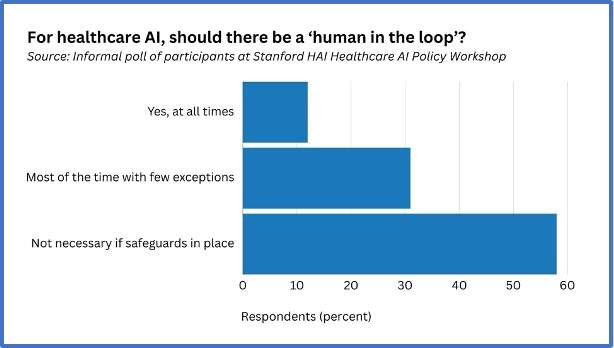

Otonom YZ araçları klinik ortamlara entegre edildiğinde her zaman bir insan döngüde olmalı mıdır? Göz rahatsızlıklarını teşhis eden veya normal göğüs röntgenlerini otomatik olarak raporlayanlar gibi tamamen otonom AI teknolojileri, ciddi doktor kaynak eksikliklerini gidermeyi vaat ediyor. Hasta e-postalarına yanıtlar taslaklayan veya doktor-hasta etkileşimleri sırasında ilerleme notları yakalayan ortam zekası teknolojileri gibi diğer otomasyon biçimleri de klinik ortamlarda verimliliği büyük ölçüde iyileştiriyor.

Bazı katılımcılar güvenlik ve güvenilirliği sağlamak için insan denetimi gerektiğini savunurken, diğerleri döngüde insan gereksinimlerinin doktorlar üzerindeki idari yükü artırabileceği ve klinik kararlardan kaynaklanan sorumluluklarını azaltabileceği konusunda uyardı. Bazıları laboratuvar testini, bir cihazın bir doktor tarafından denetlendiği ve düzenli kalite kontrollerinden geçtiği başarılı bir hibrit model olarak tanımladı.

Yapay zekanın klinik ortamlara entegrasyonu, sağlık hizmeti sağlayıcılarının ve hastaların yapay zeka araçlarını güvenli bir şekilde kullanmak için ne düzeyde şeffaflığa ihtiyaç duyduğu sorusunu da gündeme getiriyor. Geliştiricilerin, model tasarımı, işlevsellik ve riskler hakkında bilgi iletme konusunda hangi sorumlulukları var?

Ek olarak, hastalara tedavilerinin herhangi bir aşamasında YZ’nın ne zaman kullanılacağı ve eğer kullanılacaksa nasıl ve ne zaman kullanılacağı söylenmeli midir?

Kullanım Örneği 3: Hastaya Yönelik Yapay Zeka Uygulamaları

LLM’lere dayalı ruh sağlığı sohbet robotları gibi hasta odaklı uygulamaların sayısı giderek artıyor ve mobil cihazlar aracılığıyla sağlık hizmetlerine erişimi demokratikleştirmeyi veya hastalara yeni hizmetler sunmayı vaat ediyor. Yine de, bu hasta odaklı, LLM destekli uygulamaların zararlı veya yanıltıcı tıbbi bilgiler vermemesini sağlamak için hiçbir hedefli koruma önlemi alınmadı; hatta özellikle sohbet robotları tıbbi tavsiye sunmadıklarını iddia etseler bile, bilgileri tıbbi tavsiyeye çok benzeyen bir şekilde paylaşıyorlar.

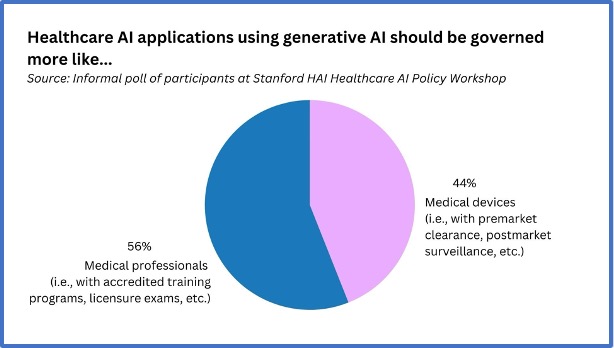

Bu hasta odaklı ürünlerin düzenleyici statüsünün açıklığa kavuşturulması acilen gereklidir. Ancak atölye katılımcıları, örneğin, üretken YZ uygulamalarının tıbbi cihazlar veya tıp uzmanları gibi daha fazla yönetilmesi gerekip gerekmediği konusunda fikir ayrılığına düştüler.

Hasta bakış açısı, sağlık hizmeti AI uygulamalarının ve daha genel olarak sağlık sisteminin güvenilirliğini sağlamak için hayati öneme sahiptir. Birçok katılımcı, hastaların hasta odaklı YZ uygulamalarının geliştirilmesine, dağıtımına veya düzenlenmesine nadiren katıldığını belirtti. Düzenleyici çerçevelerin YZ tarafından neden olunan veya daha da kötüleştirilen sağlık eşitsizliklerini ele almasını sağlamak için tüm hasta popülasyonlarının ihtiyaçları ve bakış açıları dikkate alınmalıdır.

Sırada Ne Var?

Bunlar sağlık hizmetleri YZ düzenlemesinin geleceğini çevreleyen birçok soru ve endişeden sadece birkaçı. Bu soruları yanıtlamak ve güvenliği garanti altına alırken aynı zamanda yenilikçi, hayat kurtarıcı YZ uygulamalarını pazara sunan çevik bir yaklaşımı destekleyen uygulanabilir politika çözümleri geliştirmek için çok daha fazla disiplinlerarası araştırma ve çok paydaşlı tartışmalara ihtiyaç duyulmaktadır. HAI ve Sağlık Hizmetleri YZ Politika Yönlendirme Komitesi, sağlık hizmetleri YZ’nın güvenli, adil ve etkili kullanımına yol açan politika ve düzenleyici çerçeveleri desteklemek için bu alanlarda araştırma yapmaya devam edecektir.

Stanford HAI’nin misyonu, insan koşullarını iyileştirmek için yapay zeka araştırmalarını, eğitimini, politikasını ve uygulamasını ilerletmektir.

Bu yazının çevirisi için DeepL tecüme algoritması kullanılmış ve daha sonr arevize edilmiştir.

https://hai.stanford.edu/news/how-can-we-better-regulate-health-ai