“Yapay Zeka Güvenlik Endeksi: Şirket Değerlendirmesi” başlıklı kaynak, yapay zeka sistemlerinin artan yetenekleri ve özerkliğiyle ortaya çıkan önemli risklere odaklanmaktadır. Future of Life Institute (FLI) tarafından geliştirilen bu AI Güvenlik Endeksi, dünyanın önde gelen yapay zeka şirketlerinin sistemlerini ne kadar sorumlu bir şekilde geliştirdiğini ve dağıttığını bağımsız olarak değerlendirir. Endeks, kurumsal güvenlik önlemlerini, risk yönetimi çerçevelerini ve üçüncü taraf denetimini inceleyen 33 gösterge üzerinden şirketleri puanlamaktadır. 2025 yazında yayınlanan son sürüm, yedi öncü yapay zeka şirketini güncellenmiş göstergelerle değerlendirerek, kurumsal davranışları izlemeyi ve sorumlu yapay zeka gelişimini teşvik etmeyi amaçlamaktadır. Kaynak, uluslararası alanda yapay zeka risklerine yönelik artan farkındalığı ve işbirliğini de vurgulamaktadır.

Verilen metinler, yapay zeka sektörünün güvenlik ve risk yönetimi hazırlığını inceleyen bir raporun özetini sunmaktadır. Future of Life Institute’un yapay zeka şirketlerinin ani zararları ve yıkıcı riskleri yönetme çabalarını değerlendirdiği bu ikinci analiz, sektörün hızla gelişen yeteneklerine ayak uydurmakta zorlandığını ortaya koymaktadır. Özellikle yapay genel zeka (AGI) hedeflerine rağmen, şirketlerin varoluşsal güvenlik planlamasında ciddi eksiklikler olduğu ve rekabet baskılarının güvenlik altyapısının gerisinde kaldığı vurgulanmaktadır. Raporda, Anthropic’in en iyi genel notu alırken, Çinli firmaların ise farklı düzenleyici ortamlar nedeniyle daha düşük notlar aldığı belirtilmektedir. Bu bulgular, düzenlenmemiş bir sektörde teknolojik hırsın güvenliği geride bıraktığını göstermektedir.

Endüstrinin Hazırlıksız Yükselişi

Tarih: 26 Mayıs 2024 Kaynak: “Yapay Zeka Güvenliği: Endüstrinin Hazırlıksız Yükselişi” başlıklı metinden alıntılar.

- Yönetici Özeti

Future of Life Institute’un yapay zeka güvenliği endeksi, önde gelen yedi yapay zeka şirketinin gelişmiş yapay zeka sistemlerinden kaynaklanan hem acil zararları hem de felaket risklerini yönetme çabalarına ilişkin bağımsız bir değerlendirme sunmaktadır. Uzman yapay zeka araştırmacıları ve yönetişim uzmanlarından oluşan bir uzman inceleme paneliyle yürütülen bu ikinci değerlendirme, “endüstrinin kendi hızla artan yetenek gelişmelerine ayak uydurmakta zorlandığını— kritik risk yönetimi ve güvenlik planlama boşluklarıyla giderek güçlenen yapay zeka sistemlerini kontrol etme yeteneğimizi tehdit ettiğini” ortaya koymaktadır.

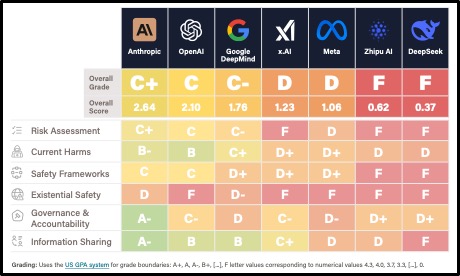

Değerlendirme, ABD GPA sistemini (A+’dan F’ye kadar notlar) kullanarak şirketlerin güvenlik performansını derecelendirmektedir. Genel sonuçlar, sektörün yapay zeka yeteneklerini geliştirmede gösterdiği hızın, bu sistemlerin güvenliğini sağlamadaki hazırlığından çok daha ileride olduğunu göstermektedir. Özellikle, yapay genel zeka (AGI) hedeflerine ulaşma iddialarına rağmen, şirketlerin varoluşsal güvenlik planlamasında ciddi eksiklikler bulunmaktadır.

- Temel Bulgular ve Ana Temalar:

“Yapay Zeka Güvenlik ve Yönetişim Endeksi”nden alınan bu metin, yedi önde gelen yapay zeka şirketinin değerlendirildiği 2025 yılı endeksinin metodolojisini özetlemektedir. Değerlendirme, 33 göstergeyi ve altı kritik alanı kapsamaktadır. Bu alanlar arasında risk değerlendirmesi, güvenlik çerçeveleri ve mevcut zararlar gibi konular bulunmaktadır. Ayrıca, varoluşsal güvenlik, yönetişim ve hesap verebilirlik gibi önemli başlıklar da incelenmektedir. Son olarak, metin bilgi paylaşımı, gönüllü iş birliği, riskler ve olayların raporlanması gibi konulara da odaklanarak, yapay zeka güvenliği ve yönetişiminin kapsamlı bir çerçevesini sunmaktadır.

Yapay Zeka Güvenliği ve Yönetişimi Endeksi: Temel Temalar ve Önemli Bulgular

Bu brifing dokümanı, “Yapay Zeka Güvenlik ve Yönetişim Endeksi” başlıklı kaynaktan alınan alıntılara dayanarak, yapay zeka (YZ) güvenliği ve yönetişimi alanındaki ana temaları, en önemli fikirleri ve olguları detaylı bir şekilde incelemektedir. 2025 Endeksi’nin metodolojisi ve değerlendirme alanları üzerinden YZ güvenliğinin çok yönlü yapısı ortaya konmaktadır.

Ana Temalar ve Kilit Bulgular

Endeks, YZ güvenliği ve yönetişimini altı kritik etki alanına yayılmış 33 gösterge aracılığıyla değerlendirerek, bu alandaki karmaşıklığı ve kapsamlılığı gözler önüne sermektedir. Ana temalar ve bunlarla ilgili önemli bulgular aşağıda sıralanmıştır:

- Risk Değerlendirmesi: Kapsamlı Test ve Doğrulama İhtiyacı

YZ sistemlerinin potansiyel tehlikelerini anlamak ve yönetmek için hem dahili hem de harici testlere verilen önem, bu temanın merkezindedir.

- Dahili Test: Şirketlerin kendi bünyelerinde gerçekleştirdikleri testler, risk değerlendirmesinin temelini oluşturur. Bu, tehlikeli yetenek değerlendirmeleri (Dangerous Capability Evaluations) ve hatta insan yükseltme denemeleri (Human Uplift Trials) gibi çeşitli metodolojileri içerir. Özellikle “Elicitation for Dangerous Capability Evaluations” ifadesi, potansiyel tehlikelerin önceden belirlenmesi ve anlaşılmasına yönelik proaktif bir yaklaşımı vurgular.

- Harici Test: Bağımsız incelemeler ve dış paydaşların katılımı, YZ sistemlerinin güvenliğini sağlamada kritik bir rol oynar. Kaynakta belirtilen “Independent Review of Safety Evaluations”, “Pre-deployment External Safety Testing” ve “Bug Bounties for Model Vulnerabilities” gibi yöntemler, üçüncü taraf doğrulaması ve topluluk tabanlı güvenlik açıklarının tespitinin önemini vurgular. Bu, sistemlerin sadece geliştiricinin bakış açısıyla değil, geniş bir perspektifle test edilmesini sağlar.

- Güvenlik Çerçeveleri: Sistematik Risk Yönetimi

YZ güvenliğini sağlamak için sistematik yaklaşımların benimsenmesi gerektiği bu tema altında işlenmektedir.

- Risk Tanımlama, Analiz ve Değerlendirme: Güvenlik çerçevelerinin temelini oluşturur. YZ sistemleriyle ilişkili potansiyel risklerin belirlenmesi, analiz edilmesi ve ciddiyetine göre değerlendirilmesi, risklerin etkin bir şekilde yönetilmesi için ilk adımdır.

- Risk İşleme: Tanımlanan risklere karşı alınacak önlemleri ve stratejileri ifade eder. Bu, risklerin azaltılması, transferi, kabulü veya kaçınılması gibi çeşitli yöntemleri içerebilir.

- Risk Yönetişimi: Güvenlik çerçevelerinin uygulanması, izlenmesi ve sürekli iyileştirilmesini sağlayan yönetim yapısı ve süreçlerini kapsar. Bu, YZ güvenliğinin statik bir durumdan ziyade dinamik ve sürekli gelişen bir süreç olduğunu gösterir.

- Mevcut Zararlar ve Model Güvenliği/Güvenilirliği: Somut Performans ve Güvenilirlik Ölçütleri

Bu tema, YZ modellerinin gerçek dünya senaryolarındaki performansı, güvenilirliği ve potansiyel zararlarını ele alır.

- Model Güvenliği / Güvenilirlik: Stanford’s HELM Safety Benchmark, Stanford’s HELM AIR Benchmark ve TrustLLM Benchmark gibi spesifik kıyaslama testlerinin kullanılması, modellerin güvenlik ve güvenilirlik performansının objektif olarak ölçülmesine verilen önemi gösterir. Bu testler, modellerin belirli güvenlik standartlarını karşılayıp karşılamadığını değerlendirmede kritik rol oynar.

- Sağlamlık (Robustness): Modellerin beklenmedik veya düşmanca girdilere karşı ne kadar dayanıklı olduğunun ölçütüdür. “Gray Swan Arena: UK AISI Agent Red-Teaming Challenge” ve “Cisco Security Risk Evaluation” gibi platformlar, modellerin saldırılara ve anormal durumlara karşı direncini test etmeyi amaçlar. “Protecting Safeguards from Fine-tuning” ifadesi, modellerin başlangıçtaki güvenlik önlemlerinin ince ayar süreçlerinde bozulmamasını sağlamanın önemini vurgular.

- Dijital Sorumluluk: İçeriklerin kökenini belirlemek için “Watermarking” kullanımı ve “User Privacy”nin korunması, YZ sistemlerinin etik ve sorumlu bir şekilde geliştirilmesi ve dağıtılması gerektiğini belirtir.

- Varoluşsal Güvenlik: Uzun Vadeli ve Stratejik Yaklaşım

Bu tema, YZ’nin insanlığa yönelik potansiyel uzun vadeli ve varoluşsal risklerini ele alır.

- Varoluşsal Güvenlik Stratejisi: YZ’nin gelecekteki gelişiminin insanlık için güvenli bir yörünge izlemesini sağlamak için proaktif stratejiler geliştirme ihtiyacını vurgular.

- Dahili İzleme ve Kontrol Müdahaleleri: YZ sistemlerinin kontrol altında tutulması ve istenmeyen sonuçların önlenmesi için şirket içi mekanizmaların varlığına işaret eder.

- Teknik YZ Güvenlik Araştırması ve Harici Güvenlik Araştırmalarını Destekleme: Varoluşsal riskleri anlamak ve azaltmak için hem dahili Ar-Ge faaliyetlerine hem de bağımsız dış araştırmaların desteklenmesine verilen önemi ortaya koyar. Bu, bilginin paylaşılması ve kolektif bir çabanın gerekliliğini gösterir.

- Yönetişim ve Hesap Verebilirlik: Şeffaflık ve Kurumsal Sorumluluk

Bu tema, YZ şirketlerinin kurumsal yapıları, şeffaflık seviyeleri ve dış paydaşlarla etkileşimleri üzerinden hesap verebilirliklerini değerlendirir.

- YZ Güvenlik Düzenlemeleri Üzerine Lobicilik: Şirketlerin YZ güvenliğiyle ilgili düzenleyici çerçevelere yönelik tutumlarını ve etkileme çabalarını değerlendirir. Bu, şirketlerin sadece operasyonel güvenliği değil, politika düzeyindeki tartışmaları da etkilediğini gösterir.

- Şirket Yapısı ve Yetkisi (Mandate): YZ güvenliğinin şirket misyonuna ne kadar entegre olduğunu ve organizasyonel yapının bunu nasıl desteklediğini inceler.

- İhbarcılık (Whistleblowing): İhbarcı politikalarının şeffaflığı, kalitesi ve şirketlerin bu konudaki geçmiş performansı, içeriden gelen güvenlik endişelerinin ne kadar ciddiye alındığını gösterir. “Whistleblowing Policy Transparency” ve “Whistleblowing Policy Quality Analysis” özellikle bu mekanizmaların etkinliğine odaklanır.

- Bilgi Paylaşımı: “Technical Specifications”, “System Prompt Transparency” ve “Behavior Specification Transparency” gibi göstergeler, YZ sistemlerinin nasıl çalıştığına dair teknik detayların ve davranışsal beklentilerin şeffaflığının önemini vurgular. Bu, dış incelemeyi ve topluluk denetimini kolaylaştırır.

- Gönüllü İşbirliği: “G7 Hiroshima AI Process Reporting” ve “FLI AI Safety Index Survey Engagement” gibi platformlarla işbirliği, şirketlerin uluslararası düzenlemelere ve bağımsız güvenlik inisiyatiflerine ne kadar gönüllü katıldığını gösterir.

- Riskler ve Olaylar: Olay Yönetimi ve Şeffaflık

Bu son tema, YZ sistemleriyle ilgili ortaya çıkan risklerin ve olayların nasıl yönetildiğini ve raporlandığını değerlendirir.

- Ciddi Olay Bildirimi ve Hükümet Bildirimleri: YZ sistemlerinde meydana gelen ciddi güvenlik ihlallerinin veya istenmeyen olayların ilgili otoritelerle nasıl paylaşıldığını inceler. Bu, acil durumlara müdahale ve kamu güvenliğinin sağlanması açısından kritik öneme sahiptir.

- Aşırı Risk Şeffaflığı ve Katılım: Şirketlerin YZ’nin potansiyel “aşırı riskleri” (extreme-risk) hakkında ne kadar şeffaf davrandığını ve bu konudaki tartışmalara ne kadar aktif katıldığını gösterir. Bu, özellikle varoluşsal güvenlik endişeleri bağlamında önemli bir göstergedir.

Sonuç

“Yapay Zeka Güvenlik ve Yönetişim Endeksi”nin metodolojisi, YZ güvenliğinin sadece teknik bir mesele olmaktan öte, kurumsal yönetim, şeffaflık, dış işbirliği ve etik sorumluluk gibi geniş bir yelpazeyi kapsayan çok boyutlu bir alan olduğunu açıkça ortaya koymaktadır. Endeks, lider YZ şirketlerini bu 33 gösterge üzerinden değerlendirerek, sektörde güvenlik ve yönetişim uygulamalarında bir standart belirlemeyi ve bu alandaki ilerlemeyi teşvik etmeyi hedeflemektedir. Verilen kaynaklardaki detaylar, YZ güvenliğinin hem mikro (şirket içi uygulamalar) hem de makro (ulusal ve uluslararası politikalar) düzeylerde ele alınması gerektiğini güçlü bir şekilde vurgulamaktadır.

2.1 Genel Notlar ve Sektör Liderleri

- Anthropic, en iyi genel notu (C+) almıştır. Şirket, risk değerlendirmelerinde önde gelmiş, tek insan katılımcılı biyolojik risk denemelerini yürütmüş, kullanıcı verileri üzerinde eğitim yapmayarak gizlilik konusunda öne çıkmış, dünya lideri uyum araştırmaları yapmış, güçlü güvenlik kıyaslama performansı sergilemiş ve Kamu Yararı Kurumu yapısı ve proaktif risk iletişimi ile yönetişim taahhüdünü göstermiştir.

- OpenAI, Google DeepMind’ın önünde ikinci sırayı almıştır. OpenAI, “ıslık çalma (whistleblowing) politikasını yayınlayan tek şirket olarak öne çıkmış, güvenlik çerçevesinde daha sağlam bir risk yönetimi yaklaşımı belirlemiş ve riskleri ön-azaltma modelleri üzerinde değerlendirmiştir.” Şirket ayrıca, harici model değerlendirmeleri hakkında daha fazla ayrıntı paylaşmış, ayrıntılı bir model spesifikasyonu sağlamış, kötü niyetli kullanım örneklerini düzenli olarak açıklamış ve AI Güvenlik Endeksi anketine kapsamlı bir şekilde katılmıştır.

2.2 Endüstrinin Hazırlıksızlığı ve AGI Çelişkisi

- Endüstri, kendi belirttiği hedefleri için temelden hazırlıksızdır. Şirketler, on yıl içinde yapay genel zekaya (AGI) ulaşacaklarını iddia etmelerine rağmen, “hiçbiri Varoluşsal Güvenlik planlamasında D’nin üzerinde not alamamıştır.” Bir hakem bu kopukluğu “derinden rahatsız edici” olarak nitelendirmiş ve insan seviyesinde yapay zekaya doğru hızla ilerlemelerine rağmen, “şirketlerin hiçbirinin bu tür sistemlerin güvenli ve kontrol edilebilir kalmasını sağlamak için tutarlı, eyleme geçirilebilir bir planı olmadığını” belirtmiştir.

2.3 Tehlikeli Yeteneklerin Test Edilmesi ve Güven Eksikliği

- Yalnızca 7 şirketten 3’ü (Anthropic, OpenAI ve Google DeepMind) biyo- veya siber terörizm gibi büyük ölçekli risklerle bağlantılı tehlikeli yetenekler için önemli testler yapmaktadır. Bir hakem, temel güvenlik testlerinin hala temel risk değerlendirme standartlarını karşılamadığını belirtmiştir: “Belirli bir değerlendirmeyi veya deneysel prosedürü riskle açıkça ilişkilendiren metodoloji/gerekçe, sınırlamalar ve niteliklerle birlikte genellikle eksiktir. […] Tehlikeli yeteneklerin önemli bir zararı önleyecek şekilde zamanında tespit edildiğine dair çok düşük güvenim var. Harici 3. taraf değerlendirmelere yapılan genel yatırımın asgari düzeyde olması, güvenimi daha da azaltmaktadır.”

- Yetenekler risk yönetimi uygulamalarından daha hızlı ilerliyor ve firmalar arasındaki fark açılıyor. Ortak bir düzenleyici tabanın olmaması, birkaç motive şirketin daha güçlü kontroller benimsemesine neden olurken, diğerleri temel güvenlik önlemlerini ihmal etmektedir, bu da gönüllü taahhütlerin yetersizliğini vurgulamaktadır.

2.4 Şeffaflık ve Yönetişim Eksiklikleri

- Islık çalma politikası şeffaflığı zayıf bir nokta olmaya devam etmektedir. Güvenlik açısından kritik endüstrilerde kamuya açık ıslık çalma politikaları yaygın bir en iyi uygulamadır çünkü harici incelemeyi sağlarlar. Ancak, değerlendirilen şirketler arasında, “yalnızca OpenAI tam politikasını yayınlamıştır ve bunu da ancak medya raporları politikanın son derece kısıtlayıcı kötüleme karşıtı maddelerini ortaya çıkardıktan sonra yapmıştır.”

2.5 Uluslararası Karşılaştırmalar ve Düzenleme İhtiyacı

- Çinli yapay zeka firmaları Zhipu.AI ve DeepSeek, genel olarak başarısız notlar almışlardır. Ancak, rapor şirketleri öz-yönetişim ve bilgi paylaşımı gibi normlar üzerinden puanlamaktadır, bu normlar Çin kurumsal kültüründe çok daha az belirgindir. Dahası, Çin’in gelişmiş yapay zeka geliştirme için zaten düzenlemeleri olduğundan, yapay zeka güvenliği öz-yönetişimine daha az bağımlılık vardır. Bu durum, diğer şirketlerin bulunduğu ve henüz öncü yapay zeka konusunda böyle bir düzenleme geçirmemiş olan Amerika Birleşik Devletleri ve Birleşik Krallık ile tezat oluşturmaktadır.

- Sonuç

Bu bulgular, “rekabetçi baskıların ve teknolojik hırsın güvenlik altyapısı ve normlarını çok geride bıraktığı, düzenlenmemiş bir endüstriyi” ortaya koymaktadır. Şirketler, “on yıl içinde insan yeteneklerine eşit veya daha iyi yapay genel zekaya (AGI) ulaşma hedeflerini sürdürdükçe bu dengesizlik daha da tehlikeli hale gelmektedir.”

Raporun erken Temmuz’da tamamlandığı ve xAI’nin Grok 4 sürümü, Meta’nın süper zeka duyurusu veya OpenAI’nin AB AI Yasası Uygulama Kodu’nu imzalama taahhüdü gibi son olayları yansıtmadığı unutulmamalıdır. Ancak bu, sektördeki temel güvenlik açıkları ve düzenleme ihtiyacı konusundaki ana mesajı değiştirmemektedir.