The Future Society / 3 Temmuz 2025

Küresel yapay zeka kırmızı çizgileri oluşturmak artık teorik bir çalışma değil. Riskler gerçek ve siyasi ivme artıyor. Ancak bunu uygulanabilir, küresel bir çerçeveye dönüştürmek harekete geçmeyi gerektirecek.

Kırmızı çizgiler serimizin 1. ve 2. bölümlerinde , yapay zeka yönetişimi için kırmızı çizgilerin neler olduğunu ve pratikte nasıl kullanıldığını ortaya koyduk. Kırmızı çizgiler serimizin bu üçüncü bölümünde ise, istekten eyleme geçmek için neler gerektiğini özetliyor ve bu çabayı ilerletmek için üç somut adım öneriyoruz.

Yapay zeka için küresel kırmızı çizgiler belirlemek kolay mı?

Kısa cevap: Hayır, ama yine de onlara ihtiyacımız var.

Uzun cevap: Yapay zekanın kırmızı çizgileri konusundaki artan ivme ve düzenleyici, çok taraflı ve sivil bağlamlarda güçlü bir temele sahip olmasına rağmen, bu kavramı sağlam bir küresel gerçekliğe dönüştürmek kolay olmayacaktır. Anlamlı sınırları tanımlamak ve uygulamak üç büyük engelle karşılaşmaktadır: jeopolitik parçalanma, teknik belirsizlik ve kurumsal boşluklar. Bu zorlukların üstesinden gelmek için öncelikle onları anlamamız gerekiyor.

İlk olarak, jeopolitik parçalanma. Amerika Birleşik Devletleri, Çin ve Avrupa Birliği de dahil olmak üzere dünyanın önde gelen yapay zeka güçleri, yapay zeka yönetimine farklı yaklaşımlara sahiptir. Bu farklılıklar hem farklı değerleri hem de stratejik öncelikleri yansıtır. Örneğin, AB Yapay Zeka Yasası, sosyal puanlama sistemlerini açıkça yasaklamaktadır. Buna karşılık, Çin UNESCO’nun Yapay Zeka Etik Tavsiyesi’ni onaylamış olsa da , çeşitli yerel yönetimler sosyal puanlama sistemlerini uygulamaya devam etmektedir.

Stratejik rekabet, koordinasyonu daha da zorlaştırır. Bazı hükümetler, güçlü düzenlemeleri inovasyon veya ulusal rekabet üzerinde bir kısıtlama olarak görerek, düzenleyici bir “dibe doğru yarış”ı körükler. Ancak bu yanlış bir tercihtir. Akıllı ve iyi tasarlanmış düzenlemeler, güvenliği artırırken ve temel haklarımızı korurken inovasyonu destekleyebilir.

Yapay zeka için küresel kırmızı çizgiler, hedefli bir amaca hizmet eder: Yapay zeka teknolojisinin yalnızca en tehlikeli davranışları ve kullanımları etrafında net sınırlar oluşturmak. Yalnızca en ciddi riskleri ve kabul edilemez zararları önlemeye odaklanarak, kırmızı çizgiler faydalı yapay zeka geliştirme ve dağıtımının önünde gereksiz engellerin oluşmasını önler. Bu yaklaşım, yapay zekanın ilerlemesinin insan değerleri ve toplumsal refahla uyumlu kalmasını sağlarken inovasyon için de alan bırakır.

İkincisi, teknik belirsizlik ve uyum sağlamanın zorluğu. Aldatma, otonom çoğaltma ve güç elde etme stratejileri gibi en endişe verici yapay zeka davranışlarından bazıları öngörülemeyen şekillerde ortaya çıkıyor. Bu riskleri ortaya çıktıkça ve büyüdükçe değerlendirmek, izlemek ve hatta net bir şekilde tanımlamak için hâlâ olgun araçlardan yoksunuz. Bu açığı kapatmak için, birbiriyle uyumlu değerlendirme yöntemlerine, erken uyarı sistemlerine ve ardışık arızaları analiz etmek için çerçevelere ihtiyacımız var.

Ancak, daha da önemlisi, ispat yükümlülüğü yapay zeka geliştiricilerinde olmalıdır. Sistemlerinin belirlenmiş kırmızı çizgileri aşmayacağını makul ve kanıta dayalı bir güvenlik gerekçesiyle deneysel olarak gösteremezlerse , onu geliştirmelerine veya dağıtmalarına izin verilmemelidir.

Üçüncüsü, kurumsal boşluklar. Şu anda yapay zeka için kırmızı çizgileri denetleyecek ve uygulayacak küresel bir altyapıya sahip değiliz. Çok taraflı beyanların ve kurumsal taahhütlerin çoğu bağlayıcı değil ve hesap verebilirlikten yoksun. İhtiyaç duyulan şey, uyumluluğu izleme, teşvikler belirleme ve sonuçları uygulama yetkisi, erişimi ve kapasitesi olan güvenilir ve bağımsız bir denetim rejimidir. Bunu inşa etmek, dikkatli bir kurumsal tasarım ve uluslararası iş birliğinin yanı sıra, yapay zeka için kırmızı çizgilere özgü zorlukları ele almak üzere izleme ve uygulama mekanizmalarına yönelik araştırma gerektirecektir.

Küresel bir yapay zeka kırmızı çizgi rejimine doğru hangi yollar izlenecek?

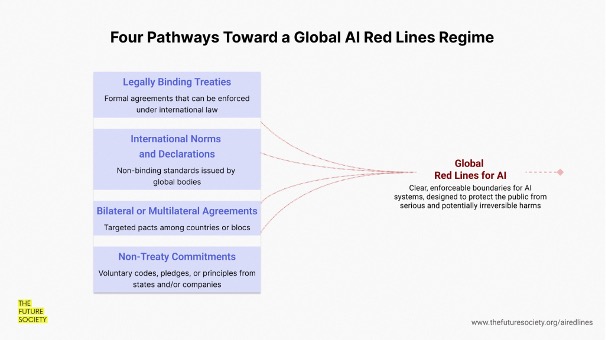

Zorluklara rağmen, küresel yapay zekâ kırmızı çizgilerinden oluşan etkili bir rejim oluşturmak hem gerekli hem de mümkündür. Tarih, son derece parçalı uluslararası ortamlarda bile ilerleme kaydedilebileceğini göstermektedir. Örneğin, silah kontrolü ve biyogüvenlik gibi alanlarda devletler, bağlayıcı anlaşmalar, gönüllü normlar, ikili anlaşmalar ve yumuşak hukuk mekanizmaları gibi araçların bir kombinasyonu yoluyla rejimler kurmuşlardır. Küresel yönetişim literatürü, tek başına hiçbir aracın yeterli olmadığını vurgulamaktadır. Bunun yerine, kalıcı rejimler genellikle örtüşen ve güçlenen çabaların sonucudur; yumuşak hukuk ve katı hukuk, koordinasyon ve hesap verebilirlik için sağlam bir mimari oluşturmak üzere etkileşime girer. Aralarındaki seçim ikili değildir; aksine, etkili küresel yönetişimin tamamlayıcı sütunları olarak işlev görürler.

Bunu akılda tutarak, küresel yapay zeka kırmızı çizgileri için işlevsel ve meşru bir rejim oluşturmaya yönelik dört ana yol belirliyoruz. Her birinin kendine özgü avantajları ve sınırlamaları vardır, ancak bunlar birbirini dışlamaz. Bir alandaki ilerleme, diğer alanlardaki ivmeyi güçlendirmeye yardımcı olabilir.

|

Küresel Yapay Zeka Kırmızı Çizgiler Rejimine Doğru Dört Yol |

||||

| Yol | Tanım | Örnek senaryo | Avantajları | Zorluklar |

| Yasal olarak bağlayıcı anlaşmalar | Uluslararası hukuk kapsamında uygulanabilen resmi anlaşmalar | BM üye ülkeleri, otonom nükleer fırlatma sistemlerini yasaklayan bir anlaşma imzaladı | • Net yasal yükümlülükler • Kurumsallaştırılmış izleme potansiyeli |

• Müzakere edilmesi yavaş • Uygulanması zor • Kilit ülkeler katılmayabilir veya onaylamayabilir • Bazen fikir birliğine varmak için sulandırılabilir |

| Uluslararası normlar ve beyanlar | Küresel kuruluşlar tarafından yayınlanan bağlayıcı olmayan standartlar | NATO üyeleri, yasal bir yaptırım olmamasına rağmen beklentileri şekillendirerek otonom yapay zeka silahları konusunda kırmızı çizgiyi teyit ediyor | • Geniş katılım • Gündem belirlemeyi ve normların yayılmasını sağlar |

• Uygulama mekanizması yok • Genellikle fikir birliğine varmak için sulandırılır • Göz ardı edilebilir |

| İkili veya çok taraflı anlaşmalar | Ülkeler veya bloklar arasında hedeflenen anlaşmalar | G20 ülkeleri, yapay zeka laboratuvarlarının kendi kendini kopyalayabilen veya kendi kendini iyileştirebilen yapay zeka modelleri geliştirmesini yasaklayan kırmızı çizgiler konusunda anlaştı. | • Evrensel anlaşmalara göre müzakere edilmesi daha kolay ve hızlıdır • Temel risklere göre uyarlanmıştır • Güven oluşturmayı teşvik edebilir • Yakın diplomatik ve ticari ilişkiler etkili uygulamayı destekleyebilir |

• Sık sık daha küçük devletleri dışlar • Jeopolitik baskı altında çökmeye eğilimlidir • Sınırlı hesap verebilirlik mekanizmaları |

| Anlaşma dışı taahhütler | Eyaletler ve/veya şirketlerden gönüllü kodlar, taahhütler veya ilkeler | Eyaletler, laboratuvarlar ve sivil toplum örgütlerinden oluşan bir koalisyon, IDAIS tarafından önerilen kırmızı çizgileri yasaklayan bir anlaşmayı imzaladı | • Esnek ve uyarlanabilir • Daha hızlı başlatılabilir • Şirketler gibi devlet dışı aktörleri içerebilir |

• Yasal sonuçları yok • Sembolik veya tutarsız uygulama riski • Potansiyel olarak ticari çıkarlara yönelik önyargılı olma olasılığı |

Tablo 1: Küresel bir yapay zeka kırmızı çizgi rejimine doğru dört yol

Bundan sonraki somut adımlar nelerdir?

Çok yönlü bir yaklaşım, ileriye dönük tek uygulanabilir yoldur. Devletlerin, şirketlerin ve sivil toplumun hepsinin oynayacağı roller var. Koordinasyon zor olacak, ancak parçalanma başarısızlık anlamına gelmek zorunda değil. Aksine, bu yolların çeşitliliği bize üzerine inşa edebileceğimiz daha geniş bir temel sağlıyor.

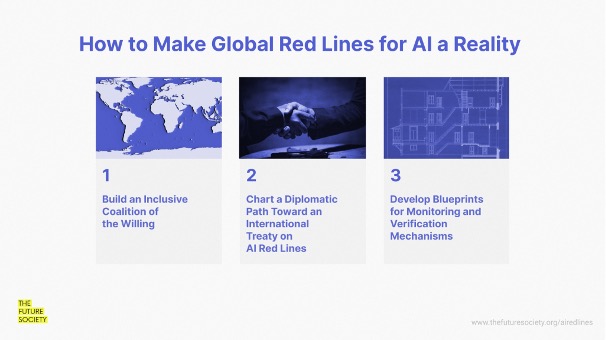

Anlamlı küresel yapay zeka kırmızı çizgilerinin oluşturulmasını somut olarak ilerletmeye yardımcı olabilecek üç somut adımla bitiriyoruz:

- İsteklilerin kapsayıcı bir koalisyonunu kurun.

Evrensel bir mutabakat için beklememeliyiz. Hükümetler, uluslararası kurumlar, sorumlu şirketler, sivil toplum ve akademiden oluşan bir “istekliler koalisyonu” ilk adımları atabilir. IDAIS Bildirisi, mutabakat için bir temel sunuyor. Şimdi, küresel eylem için ivme yaratmak adına bilim insanları, politika yapıcılar ve sivil toplum liderlerinin daha geniş desteğiyle genişletilmesi gerekiyor.

En önemlisi, kırmızı çizgiler yalnızca baskın aktörler tarafından şekillendirilirse meşruiyetten yoksun kalacaktır. Küresel Güney hükümetleri, yerli topluluklar ve yeterince temsil edilmeyen sesler masada olmalıdır. Küresel değerleri ve yaşanmış gerçekleri yansıtan kırmızı çizgiler tasarlamak için kapsayıcılık esastır.

- Yapay zekanın kırmızı çizgileri konusunda uluslararası bir antlaşmaya doğru diplomatik bir yol çizin.

Artan ivmeyle, bir sonraki adım, günümüzün siyasi gerçekleri içindeki kırmızı çizgileri işlevsel hale getirmektir. Diplomatik camianın katılımı çok önemlidir. Tüm kırmızı çizgiler üzerinde evrensel bir fikir birliği beklemek yerine, bağlayıcı bir uluslararası çerçeveye doğru net ve kademeli yollar belirlemek için diplomatlarla yakın bir şekilde çalışmalıyız. İkili ve bölgesel anlaşmalar, bağlayıcı olmayan çok taraflı normlar ve standartlar, basamak taşları görevi görebilir.

Bu çabaların tüm olası kırmızı çizgileri kapsaması gerekmez. Bunun yerine, politika pencerelerinin zaten açık olduğu alanlara odaklanabilirler. Birçok kırmızı çizgi halihazırda geniş destek görüyor: örneğin, kendi kendini kopyalayan yapay zeka sistemlerinin yasaklanması, nükleer komuta ve kontrolün insan gözetiminde olmasının sağlanması, kitlesel gözetimin, insan taklidinin, çocukların manipüle edilmesinin ve sentetik medya kullanılarak büyük ölçekli etki operasyonlarının yasaklanması. Bu tür bir yapı, güven oluşturmaya, normları tanımlamaya ve gelecekteki anlaşma taahhütleri için gereken yasal ve kurumsal altyapıyı oluşturmaya yardımcı olabilir.

- İzleme ve doğrulama mekanizmalarına yönelik planlar geliştirin.

Bu kırmızı çizgilerin gerçekte etkili olabilmesi için, izleme ve doğrulama altyapısıyla birlikte sunulmaları gerekir. Bunları teknik, yasal ve kurumsal olarak operasyonel hale getirmeye hazır olmalıyız. Bu, izleme ve doğrulama mekanizmaları geliştirmek anlamına gelir: dağıtımdan önce uyumluluğu doğrulamak, dağıtımdan sonra ihlalleri tespit etmek ve kurallar çiğnendiğinde sorumluluğu atfetmek için araçlar. Nihayetinde, sistemlerinin kırmızı çizgilere uyduğunu kanıtlama ve uymaması durumunda ciddi sonuçlarla karşılaşma sorumluluğu geliştiricilere ait olmalıdır. Bir örnek, yapay zeka çiplerinin kullanımını izleyebilen ve uyumsuz hesaplamaları engelleyebilen donanım destekli güvence mekanizmaları olabilir . Diğer teknik bileşenler arasında bağımsız denetimler, sistem raporlama protokolleri ve adli yetenekler bulunabilir. Bu muhtemelen doğrulama mekanizmalarının araştırılması ve geliştirilmesi ve pilot uygulamaların yürütülmesi için de fon gerektirecektir.

Ancak teknik araçlar tek başına yeterli değil. Kurumsal tasarım da aynı derecede kritik. Kim izliyor? Kim araştırıyor? Kırmızı çizgiler aşılırsa ne olur? Çıkar çatışması yaşayan devletler arasında güven nasıl sağlanır? Bağımsız, meşru ve harekete geçmek için gerekli kaynaklara sahip gözetim kurumlarına ihtiyacımız var. İzleme ve doğrulama, kırmızı çizgilerin gerisinde kalmamalı, onlarla birlikte gelişmelidir.

Çözüm

İleriye giden yol açık: Yapay zeka kırmızı çizgileri etrafındaki artan ivmeyi somut ve uygulanabilir küresel eylemlere dönüştürmenin zamanı geldi. Bu üç bölümlük açıklayıcı dizide, kırmızı çizgilerin en tehlikeli yapay zeka davranışlarına ve kullanımlarına karşı kritik korumalar olarak hizmet ettiğini ortaya koyduk ve temel politikaların farklı yargı bölgeleri ve bağlamlarda halihazırda ortaya çıktığını gösterdik. Asıl zorluk, bu çabaları yapay zeka risklerinin küresel doğasına uyacak şekilde ölçeklendirmekte yatıyor.

Yapay zeka yetenekleri hızla ilerledikçe proaktif yönetim için pencere daralıyor ve bu da parçalı, gönüllü yaklaşımların ötesine geçip gerçek anlamda etkili, koordineli uluslararası çerçevelere doğru ilerlememizi zorunlu kılıyor.

Artık soru, yapay zeka kırmızı çizgilerine ihtiyacımız olup olmadığı değil, bunları gerçeğe dönüştürmek için gerekli uluslararası iş birliğini ne kadar hızlı kurabileceğimizdir.

Bu makale, Yapay Zeka için Küresel Kırmızı Çizgiler konulu üç bölümlük açıklayıcı serinin üçüncü bölümüdür. Serinin genel bakışına buradan , 1. bölüme buradan ve 2. bölüme buradan ulaşabilirsiniz .