Rosmund Powel / Temmuz 2024

Bu belge , uluslararası yapay zeka düzenleme girişimlerinin ulusal güvenlik üzerindeki etkilerine ilişkin The alan turing Institute Açıklayıcı dizisinin birinci bölümüdür .

Giriş

AB Yapay Zeka Yasası’nın, yapay zeka (YZ) için bugüne kadarki en kapsamlı yasal çerçeve olması bekleniyor. Bu yeni düzenleme, hem AB’de hem de AB dışında ulusal güvenlik açısından önemli etkilere sahip olacak. Bu CETaS Açıklaması, yasanın uygulanmasına hazırlık aşamasında ulusal güvenlik topluluğunun dikkate alması gereken temel hususları ortaya koymaktadır.

AB Yapay Zeka Yasası nedir?

AB Yapay Zeka Yasası, yapay zekaya ilişkin ilk kapsamlı uluslararası düzenlemedir. Yapay zekanın oluşturduğu risklere karşı temel hakları korumayı ve yapay zekanın güvenli bir şekilde geliştirilip kullanılmasını sağlamayı amaçlamaktadır. 21 Mayıs 2024 tarihinde Avrupa Birliği Konseyi tarafından onaylanmış ve 1 Ağustos 2024 tarihinde yürürlüğe girecektir . [1]

Kanunun temel hükümleri nelerdir?

- Yapay zeka düzenlemesine yönelik kademeli, risk temelli bir yaklaşım oluşturur.

- ‘Kabul edilemez risk’oluşturduğu düşünülen yapay zeka sistemlerine kesin yasaklar getirir .

- Yüksek riskli yapay zeka geliştiricilerine, zorunlu risk yönetimi süreçleri ve teknik güvenlik dokümantasyonu gibi yeni yükümlülükler getirir .

- ‘Genel amaçlı’ yapay zeka modelleri içinözel hükümler ve sınırlı riskli yapay zeka sistemleri etrafında şeffaflık gereklilikleri getiriyor.

Kanunun kapsamı nedir?

- Yasanın kapsam alanı sınır ötesidir ve AB içinde faaliyet gösteren tüm kuruluşlara, başka yerlerde yerleşik olsalar bile uygulanacaktır. [2]

- Ulusal güvenlikve savunma amaçlı yapay zeka uygulamaları ile yalnızca bilimsel araştırma ve geliştirme amacıyla geliştirilen yapay zekalar için sektörel istisnalar yapılmıştır .

- Açık kaynaklıyapay zeka, kolluk kuvvetleri uygulamaları ve kamu güvenliği için de bazı özel düzenlemeler yapılmıştır . [3]

AB Yapay Zeka Yasası daha geniş düzenleyici çerçevede nerede yer alıyor?

- AB Yapay Zeka Yasası, uluslararası kapsamı ve kapsamlı gereklilikleri göz önüne alındığında türünün ilk mevzuatıolmakla birlikte, küresel ölçekte geçerli tek yapay zeka düzenlemesi değildir.

- Avrupa ve diğer yerlerdeki diğer düzenleyici çabaların da önemli etkileri olacak:

- Uluslararası alanda, Yapay Zeka ve İnsan Haklarına İlişkin Avrupa Konseyi Sözleşmesi Mayıs 2024’te kabul edildi ve 2024’ün ilerleyen dönemlerinde onaylanacak. [4]

- Ulusal hükümetler de ilerleme kaydetti. En dikkat çekici olanı, ABD’nin Yapay Zeka Yönetmeliği’nin Ekim 2023’te yayınlanmasıydı [5], Çin’deki Yapay Zeka Düzenlemesi ise daha da erken ortaya çıktı (2021, 2022 ve 2023’teki temel düzenlemeler dahil). [6]

- Son olarak, özellikle ABD’dehızla ilerleyen eyalet düzeyindeki yapay zeka düzenlemeleri olmak üzere bazı yerel mevzuatlar önemli olacaktır . [7]

AB Yapay Zeka Yasası’nın, özellikle genel veri koruma düzenlemesi ( GDPR) , Dijital Piyasalar Yasası ve Dijital Hizmetler Yasası olmak üzere diğer AB dijital düzenlemeleri bağlamında konumlandırılması da büyük önem taşımaktadır . [8]

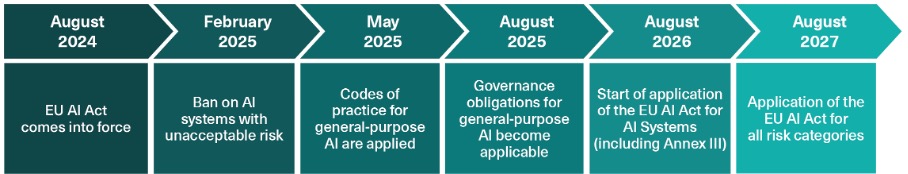

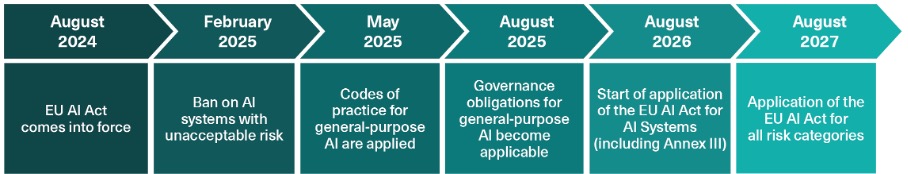

Zaman çizelgesi

Risk Tabanlı Yaklaşım

AB Yapay Zeka Yasası, uyum yükümlülüğünün yapay zeka sistemlerinin oluşturduğu risklerle orantılı olmasını sağlamak için yapay zeka düzenlemelerine “risk temelli bir yaklaşım” benimsiyor. Nihai Yapay Zeka Yasası’nda, yapay zeka sistemleri her biri farklı gerekliliklere sahip beş kategoriye ayrılıyor (Şekil 2).

- ‘Kabul edilemez’ düzeyde risk oluşturan yapay zeka sistemleri, sosyal puanlama sistemleri ve işyerlerinde ve eğitim kurumlarında duygu çıkarımı da dahil olmak üzere tamamen yasaklandı. [9]

- Yapay zeka yaşam döngüsü boyunca bir risk yönetim sistemi kurma ve teknik dokümantasyon hazırlama gereksinimi de dahil olmak üzere çoğu yükümlülük, ‘yüksek riskli’ yapay zeka sistemi geliştiricilerine ayrılmıştır. [10]

- AB Komisyonu, şu anda çoğu yapay zeka sisteminin ‘asgari riskli’ kategoriye girdiğini ve herhangi bir düzenleyici gereklilikle karşılaşmayacağını vurguladı. [11]Ancak, yapay zekadaki değişimin hızlı temposu göz önüne alındığında, Kanun yürürlüğe girdiğinde bunun hala geçerli olup olmadığı konusunda netliğe ihtiyaç duyulabilir.

- Genel amaçlı yapay zeka modelleri için, risk düzeyine orantılı olarak özel hükümler getirilmiştir. Bunlar arasında şeffaflık yükümlülükleri, sistemik risklerin öz değerlendirmesi ve azaltılması, ciddi olayların raporlanması, model değerlendirmelerinin yapılması ve siber güvenlik korumalarının sağlanması yer almaktadır. [12]

AB Yapay Zeka Yasası’ndan istisnalar.

AB Yapay Zeka Yasası, çeşitli sektörel istisnalar içerirken, bazı sektörler hala Yasanın kapsamındadır ancak özel hükümlerle birlikte gelir (Şekil 3)

Ulusal Güvenlik Dışlanması

Neden ulusal güvenlik hariç tutuluyor?

Kanuna ulusal güvenlik nedeniyle bir istisna eklenmesinin iki nedeni vardır:

- Ulusal güvenlik, TEU’nun (Avrupa Birliği Anlaşması) 4(2) maddesi uyarınca yalnızca Üye Devletlerin sorumluluğundadır.

- Ulusal güvenlik faaliyetlerinin özel niteliği ve operasyonel ihtiyaçları ve bu faaliyetlere uygulanabilir özel ulusal kurallar. [13]

Bu istisnanın kapsamı nasıl tanımlanıyor?

- Bu istisna, yalnızca ulusal güvenlik amaçları doğrultusunda yapay zeka sistemleri geliştiren hem kamu hem de özel kuruluşlar için geçerlidir.

- Bu istisna, ulusal güvenlik bağlamı dışında da kullanılan herhangi bir ikili kullanım teknolojisi için geçerli değildir.

- Yasada ‘ulusal güvenlik’ tanımı yapılmamıştır. [14]

Bu dışlama neden tartışılıyor?

Ulusal güvenlik nedeniyle hariç tutma, hem AB Yapay Zeka Yasası müzakereleri sırasında [15] hem de insan hakları grupları tarafından [16] kapsamlı bir şekilde tartışıldı . Tartışmanın temel noktaları şunlardır:

- ‘Ulusal güvenlik’ kavramının kapsamının net olmaması.

- Bazıları, ‘ulusal güvenlik’ kavramının AB hukukunda açıkça tanımlanmadığını, Üye Devletler tarafından bu terimin nasıl yorumlandığı konusunda önemli farklılıklar olduğunu ve bu durumun, Kanun’dan hariç tutulan ve hariç tutulmayan konular arasındaki çizginin nerede çizilmesi gerektiği konusunda endişelere yol açtığını ileri sürmektedir. [17]

- Bu argümanlar, Avrupa Birliği Adalet Divanı’nın 2020 yılında ilk kez ulusal güvenliği, ‘bir ülkenin temel anayasal, siyasal, ekonomik veya toplumsal yapılarını ciddi biçimde istikrarsızlaştırabilecek ve özellikle toplumu, halkı veya devletin kendisini doğrudan tehdit edebilecek terör eylemleri gibi faaliyetlerin önlenmesi ve cezalandırılmasını kapsayan’ bir sorumluluk olarak resmen tanımlamasına rağmen ileri sürülmektedir. [18]

- Potansiyel olarak ‘ulusal güvenlik’ ile ‘kamu güvenliği’ arasındaki sınırlar belirsizleşebilir.

- İnsan hakları gruplarının, yüksek riskli ulusal güvenlik bağlamlarında yapay zekanın düzenlenmesi gerekliliği konusundaki argümanları.

- Birçok insan hakları grubu, ulusal güvenlik nedeniyle dışlanmanın ‘AB antlaşmaları uyarınca haklı olmadığını’ ve muafiyetlerin ‘AB Temel Haklar Şartı’na uygun olarak vaka bazında değerlendirilmesi gerektiğini’ savundu. [21]

Ulusal güvenlik yapay zekası kullanım örneklerinin yüksek riskli doğası, göç, gözetim ve biyometri gibi bağlamlarda yapay zekanın hassas kullanımlarının kontrol edilmemesi konusunda özel endişelere yol açmıştır. Örneğin, marjinal grupları orantısız bir şekilde etkileme potansiyeline sahip gözetim teknolojileri ve göç bağlamında kullanılan risk değerlendirme teknolojileri konusunda endişeler dile getirilmiştir. [22]

AB Yapay Zeka Yasası Ulusal Güvenlik Açısından Neden Hâlâ Önemli?

Bu istisnalara rağmen, AB Yapay Zeka Yasası, hem AB içinde hem de dışında ulusal güvenlik topluluğu için önemli etkilere sahip olacaktır. Ulusal güvenlik topluluğu, aşağıdaki temel değişikliklere hazırlıklı olmalıdır.

Çift kullanımlı teknolojiler

Ulusal güvenliğin AB Yapay Zeka Yasası’ndan hariç tutulması, yalnızca yapay zeka teknolojilerinin yalnızca ulusal güvenlik amacıyla kullanıldığı durumlarda geçerlidir. Bir yapay zeka sisteminin sivil, insani, kolluk kuvvetleri veya kamu güvenliği amaçlarıyla da kullanıldığı tüm ikili kullanım durumlarında, Yapay Zeka Yasası geçerli olmaya devam edecektir. [23]

Hazırlıksız kalmamak için, ulusal güvenlik topluluğu, çift kullanımlı yapay zekâ teknolojilerinin kullanımının Kanun kapsamına ne ölçüde girebileceğini değerlendirmelidir. Bu, ulusal güvenlik yapay zekâ inovasyonunun aşağıda daha derinlemesine incelenen iki temel alanı için en önemli olacaktır:

- Açık kaynaklı yapay zeka da dahil olmak üzere endüstriden tedarik edilen veya uyarlanan yapay zeka uygulamaları.

- Kolluk kuvvetleri gibi diğer kamu sektörü kurumlarıyla paylaşılan yapay zeka uygulamaları.

Değişen bir endüstri manzarası

Yapay Zeka Yasası etrafındaki tartışmalara sıklıkla endüstri inovasyonunun potansiyel olarak engellenmesiyle ilgili endişeler hakim oluyor. [24] Yasada belirtilen ulusal güvenlik istisnaları, ulusal güvenlik topluluğu için diğer sektörlere kıyasla endüstri inovasyonunun azalmasıyla ilgili endişelerin daha az şiddetli olabileceği anlamına geliyor.

Ancak iki etken bir araya gelince ulusal güvenliğin tam anlamıyla güvence altına alınamayacağı ortaya çıkıyor.

- Son yıllarda ulusal güvenlik topluluğu, yapay zeka konusunda özel sektörle ilişkisini güçlendirdi. [25]Maliyetler, ulusal güvenliğin belirli yetenekleri, örneğin üretken yapay zeka yeteneklerini sıfırdan geliştirmesini haklı çıkarmasını zorlaştırıyor. Bunun yerine, üçüncü taraf yapay zekası genellikle inovasyondan yararlanmanın en iyi yoludur. [26]

- Savunma ve ulusal güvenlik için yeni yapay zeka yeteneklerinin geliştirilmesi nadiren ‘hükümet teknoloji uzmanları veya savunma yüklenicileri’ ile başlar. [27]Bunun yerine, ulusal güvenlik topluluğu genellikle herkesle aynı yapay zeka sistemleriyle ilgilenir ve çoğu durumda, endüstrinin yalnızca onlar için yapay zeka ürünleri geliştirmesini değerli kılacak kadar büyük bir pazar oluşturmazlar.

AB Yapay Zeka Yasası, Avrupa’da Yapay Zeka inovasyonunu engellerse [28] veya yeni kurulan şirketlerin başarısını engellerse [29], bu dinamikler, Yapay Zeka Yasası’ndaki istisnalara rağmen ulusal güvenlik inovasyonunu bir dereceye kadar etkileyecektir. Bu sorun, özellikle yapay zeka inovasyonunun jeopolitik dinamiklerinde bir değişime katkıda bulunursa endişe verici hale gelebilir. Bu nedenle, ulusal güvenlik topluluğunun Yapay Zeka Yasası’nın küresel inovasyon modellerini ne ölçüde etkilediğini takip etmesi hayati önem taşımaktadır.

Bununla birlikte, Yasanın sektör inovasyonunu ne ölçüde etkileyeceği henüz belirsizliğini koruyor. Yasanın kademeli olarak uygulanması, AB’nin öncü olma avantajını azaltabilirken, ABD’de yapay zeka düzenlemelerine yönelik daha yumuşak bir yaklaşım benimsenmesi, AB yaklaşımının küresel teknoloji sektörü üzerindeki etkisini azaltabilir. [30] Aynı zamanda, AB yetkilileri inovasyonun yüksek bir öncelik olduğunu vurgulayarak, örneğin kaç yapay zeka ürününün “minimum riskli” kategoriye gireceğini belirtip düzenleyici deneme alanları gibi inovasyon yanlısı girişimleri vurguluyor. [31]

Son olarak, Yasa kesinleşmiş olmasına rağmen, örneğin ‘genel amaçlı’ yapay zeka modelleri etrafında Uygulama Kuralları tasarlanması gibi konularda daha fazla karar alınması gerekiyor. [32] AB Yapay Zeka Yasası’nın endüstriyi ne ölçüde etkileyeceğini ve ulusal güvenlik açısından domino etkisi yaratacağını değerlendirmek için daha fazla zamana ihtiyaç var.

Hukukun uygulanması üzerindeki etkiler

Kolluk kuvvetleri, bir dizi özel hüküm ve istisnanın uygulandığı Yapay Zeka Yasası kapsamındadır. Bunun ulusal güvenlik açısından iki önemli sonucu olacaktır.

- Ulusal güvenlik ve kolluk kuvvetleri arasında paylaşılan tüm yeteneklerin, Kanuna uyumun sağlanması için gözden geçirilmesi gerekecektir; kolluk kuvvetleri faaliyetleri ile ulusal güvenlik faaliyetleri arasındaki kesin ayrım da aynı şekilde yapılacaktır. Sivil toplum grupları, kanunda sunulan geniş kolluk kuvvetleri tanımı ve ulusal güvenlik için herhangi bir tanımın bulunmaması nedeniyle bu ayrımın belirsiz olabileceğini savunmuşlardır [33] vebu durum, bir teknolojinin kolluk kuvvetleri yerine yalnızca ulusal güvenlik için kullanılıp kullanılmayacağını önceden belirlemede önemli pratik zorluklara yol açmaktadır . [34] Altı ay içinde yasaklanacak sekiz yapay zeka uygulamasından ikisinin kolluk kuvvetleri teknolojileri olduğu göz önüne alındığında [35] , kolluk kuvvetlerine yönelik yapay zeka ve AB Yapay Zeka Yasası’nın ulusal güvenlik açısından öncelikli olarak ele alınması gerekmektedir.

- Kolluk kuvvetlerine, ulusal güvenlikte yapay zekanın geleceği için dersler sunabilecek AB Yapay Zeka Yasası’ndan belirli muafiyetler tanınmıştır. Örneğin, Yasa, kolluk kuvvetlerindeki yüksek riskli yapay zeka sistemleri için kayıt yükümlülüklerinin AB veri tabanının kamuya açık olmayan bir bölümünde yerine getirilebileceğini ve yüksek riskli yapay zeka sistemleri için piyasaya sürüldükten sonra yapılan izlemenin hassas operasyonel verileri kapsamaması gerektiğini belirtmektedir. [36]AB kolluk kuvvetleri Yasayı uygulamaya başladıkça, ulusal güvenlik topluluğu, yapay zeka risklerini raporlamaya yönelik bu kamuya açık olmayan seçeneklerin pratikte nasıl geliştiğini gözlemlemelidir. Küresel olarak neredeyse tüm yapay zeka düzenleme girişimlerinin yapay zeka geliştiricileri için şeffaflık yükümlülüklerinin önemini vurguladığı göz önüne alındığında, gelecekte ulusal güvenlik kuruluşlarının hassas bilgileri ifşa etmeden yapay zeka riski raporlama gerekliliklerini nasıl karşılayabileceklerini değerlendirmek önemli hale gelebilir.

Yapay zeka risk yönetimi ve insan hakları güvenceleri için yeni en iyi uygulama

Uyumluluk gerekliliklerinin dışında kalmasına rağmen, ulusal güvenlik, Yapay Zeka Yasası’nda belirtilen en iyi uygulamalardan ders çıkarabilir. Örneğin:

- ‘Yüksek riskli yapay zeka’ için belirlenen gereklilikler arasında, uygun doğruluk, sağlamlık ve siber güvenlik seviyelerini garanti altına almak için tüm yaşam döngüsünü kapsayan bir risk yönetim sistemi kurma, teknik dokümantasyon hazırlama ve kamu sektörü uygulayıcıları için temel haklar etki değerlendirmesi yapma gereksinimi yer almaktadır. [37]

- ‘Sistemik risk’ içeren ‘genel amaçlı’ modeller için belirlenen gereksinimler arasında ciddi olay raporlaması ve düşmanca testlere duyulan ihtiyaç da yer almaktadır. [38]

Bazıları bu gerekliliklerin yapay zeka geliştiricileri için aşırı külfetli olacağını savundu [39], ancak ekstra dikkat gerektiren bir alan varsa, bu, yapay zeka yaşam döngüsünün her aşamasında beklenmeyen sonuçlardan kaçınmak için yeterli incelemenin şart olduğu ulusal güvenliktir. [40] Ulusal güvenlik yapay zeka kullanım durumları, siber güvenlik, sağlamlık ve doğruluk için özellikle yüksek gerekliliklere sahiptir [41] ve bunların hepsi Kanun’un 15. Maddesinde belirtilmiştir. [42] Düzenlemeye dahil edilmemiş olmasına rağmen, AB genelindeki ulusal güvenlik kurumları, en iyi uygulamaları uygulayarak yapay zeka risklerini ele almaya öncelik vermeli ve bunu yaparken Kanun’da belirtilen hangi hükümleri ve en iyi uygulamaları gönüllü olarak uygulayabileceklerini göz önünde bulundurmalıdır.

Ek olarak, Kanun, özellikle Avrupa standart geliştirme kuruluşları (SDO’lar) CEN/CENELEC ve ETSI’de, yapay zeka konusunda uluslararası teknik standartların geliştirilmesinin hızlandırılmasına yardımcı olmaktadır. Endüstri liderliğinde ve gönüllülük esasına dayalı olan uyumlu teknik standartlar, Kanun’un gerekliliklerinin geliştiriciler tarafından nasıl hayata geçirilebileceğini belirleyecekleri için Yapay Zeka Kanunu için kilit öneme sahiptir. SDO’ların, yüksek riskli yapay zeka gerekliliklerinin Ağustos 2026’da yürürlüğe girmesi için standartları zamanında yayınlamaları için Nisan 2025 tarihi önemli bir son tarih olarak belirlenmiştir. [43] Yine, bu standartların uygulanması ulusal güvenlik için zorunlu olmayacaktır, ancak yine de yapay zekanın güvenli ve etik bir şekilde konuşlandırılması için faydalı bir ölçüt sağlamaktadırlar.

Son olarak, Kanun’da belirtilen risk yönetimi süreçleri endüstri için zorunlu hale geldikçe, ulusal güvenlikte yapay zeka tedariki için faydalar sağlanabilir. Endüstri tedarikçileri yüksek riskli ve genel amaçlı yapay zeka ile ilgili gerekliliklere uymaya başladıkça, Kanun sayesinde ulusal güvenlik müşterilerine daha fazla bilgi sunulması muhtemeldir. Bu durum, ulusal güvenlik için yapay zeka güvencesini kolaylaştırma potansiyeline sahiptir. [44]

Çözüm

Ulusal güvenlik topluluğu, AB Yapay Zeka Yasası’nın etkilerine şimdiden hazırlanmalı ve özellikle Yasa’nın kolluk kuvvetlerini ve sektör inovasyonunu nasıl etkileyeceğine odaklanmalıdır. Aynı zamanda, özellikle uluslararası teknik standartlardaki ilerleme ve sektörde beklenen Yapay Zeka risk dokümantasyonunda artış sayesinde, Yasa’nın bir sonucu olarak elde edilebilecek potansiyel faydaları da değerlendirmelidirler.

Referanslar

[1] Avrupa Komisyonu, “Yapay Zeka Yasası”, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai ; Avrupa Birliği Konseyi, “Yapay zeka (AI) yasası: Konsey, yapay zeka ile ilgili ilk dünya çapındaki kurallara son yeşil ışığı yaktı”, Basın bülteni, 21 Mayıs 2024, https://www.consilium.europa.eu/en/press/press-releases/2024/05/21/artificial-intelligence-ai-act-council-gives-final-green-light-to-the-first-worldwide-rules-on-ai/ .

[2] Tim Hickman, “AB Yapay Zeka Yasası’nın sınır ötesi kapsamı – Bölüm 2”, White & Case Makalesi, 9 Mayıs 2024, https://www.whitecase.com/insight-our-thinking/eu-ai-acts-extraterritorial-scope-part-2 .

[3] Daniel Castro, “AB’nin Yapay Zeka Yasası, Açık Kaynaklı Yapay Zeka için Düzenleyici Karmaşıklık Yaratıyor”, Veri İnovasyonu Merkezi, 4 Mart 2024, https://datainnovation.org/2024/03/the-eus-ai-act-creates-regulatory-complexity-for-open-source-ai/ .

[4] Pascale Davies, “Avrupa Konseyi ilk bağlayıcı uluslararası AI anlaşmasını kabul etti”, Euronews , 17 Mayıs 2024, https://www.euronews.com/next/2024/05/17/council-of-europe-adopts-first-binding-international-ai-treaty .

[5] Beyaz Saray, “Bilgi Notu: Başkan Biden Güvenli, Emniyetli ve Güvenilir Yapay Zeka Hakkında Yürütme Kararı Yayınladı”, 30 Ekim 2023, https://www.whitehouse.gov/briefing-room/statements-releases/2023/10/30/fact-sheet-president-biden-issues-executive-order-on-safe-secure-and-trustworthy-artificial-intelligence/ .

[6] Matt Sheehan, “Çin’in Yapay Zeka Düzenlemeleri ve Nasıl Yapıldıkları”, Carnegie Uluslararası Barış Vakfı Belgesi, 10 Temmuz 2023, https://carnegieendowment.org/research/2023/07/chinas-ai-regulations-and-how-they-get-made .

[7] Cobun Zweifel-Keegan, “ABD Eyalet Yapay Zeka Yönetişim Mevzuatı İzleyicisi”, IAPP Makalesi, son güncelleme 25 Haziran 2024, https://iapp.org/resources/article/us-state-ai-governance-legislation-tracker/ .

[8] White & Case, “AI Watch: Küresel düzenleyici takip aracı – Avrupa Birliği”, White & Case Insight, 21 Mayıs 2024, https://www.whitecase.com/insight-our-thinking/ai-watch-global-regulatory-tracker-european-union .

[9] “Yapay Zeka Yasası’nın Üst Düzey Özeti”, AB Yapay Zeka Yasası, Yaşamın Geleceği Enstitüsü, son güncelleme 30 Mayıs 2024, https://artificialintelligenceact.eu/high-level-summary/ .

[10] Aynı.

[11] Latham & Watkins, AB Yapay Zeka Yasası: Cesur Yeni Bir Dünyada Seyir (Latham & Watkins LLP: Temmuz 2024), https://www.lw.com/en/admin/upload/SiteAttachments/EU-AI-Act-Navigating-a-Brave-New-World.pdf .

[12] Avrupa Komisyonu, “Yapay Zeka Yasası”, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai .

[13] Avrupa Parlamentosu, “Yapay Zeka Yasası”, https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf .

[14] Avrupa Parlamentosu, “Yapay Zeka Yasası”, https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf .

[15] Gian Volpicelli, “AB’nin yapay zeka görüşmeleri müdahaleci güvenlik açıkları nedeniyle tıkandı”, Politico , 7 Aralık 2023, https://www.politico.eu/article/ai-act-negotiations-enter-their-19-hour/ .

[16] Kâr Amacı Gütmeyen Kuruluşlar Hukuku için Avrupa Merkezi, “AB Yapay Zeka Yasası’nın (AIA) Kapsamı: Askeri Amaçlar ve Ulusal Güvenlik”, tarih yok,

https://ecnl.org/sites/default/files/2022-03/ECNL%20Pagers%20on%20scope%20of%20AIA%20ECNL_FINAL.pdf ; Avrupa Engellilik Forumu, “AB’nin Yapay Zeka Yasası insan hakları için altın standart belirleyemedi”, 3 Nisan 2024, https://www.edf-feph.org/publications/eus-ai-act-fails-to-set-gold-standard-for-human-rights/ .

[17] Morrison Foerster, “AB Yapay Zeka Yasası – Yapay Zeka Konusunda Avrupa Parlamentosu Tarafından Onaylanan Önemli Yasa”, 14 Mart 2024, https://www.mofo.com/resources/insights/240314-eu-ai-act-landmark-law-on-artificial-intelligence#section11 ; Avrupa Kâr Amacı Gütmeyen Hukuk Merkezi, “AB Yapay Zeka Yasası’nın (AIA) Kapsamı: Askeri Amaçlar ve Ulusal Güvenlik”, tarih yok,

https://ecnl.org/sites/default/files/2022-03/ECNL%20Pagers%20on%20scope%20of%20AIA%20ECNL_FINAL.pdf .

[18] Kâr Amacı Gütmeyen Kuruluşlar Hukuku için Avrupa Merkezi, “AB Yapay Zeka Yasası’nın (AIA) Kapsamı: Askeri Amaçlar ve Ulusal Güvenlik”, tarih yok,

https://ecnl.org/sites/default/files/2022-03/ECNL%20Pagers%20on%20scope%20of%20AIA%20ECNL_FINAL.pdf .

[19] Avrupa Parlamentosu, “Yapay Zeka Yasası”, https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf .

[20] Morrison Foerster, “AB Yapay Zeka Yasası – Yapay Zeka Konusunda Avrupa Parlamentosu Tarafından Onaylanan Önemli Kanun”, 14 Mart 2024, https://www.mofo.com/resources/insights/240314-eu-ai-act-landmark-law-on-artificial-intelligence#section11 .

[21] Avrupa Engellilik Forumu, “AB’nin Yapay Zeka Yasası, insan hakları için altın standart belirleyemedi”, 3 Nisan 2024, https://www.edf-feph.org/publications/eus-ai-act-fails-to-set-gold-standard-for-human-rights/ ; Avrupa Kâr Amacı Gütmeyen Hukuk Merkezi, “ECNL’nin AB Yapay Zeka Yasası Hakkındaki Pozisyon Beyanı”, 26 Temmuz 2021, https://ecnl.org/news/ecnl-position-statement-eu-ai-act .

[22] Access Now, “Ortak açıklama – Tehlikeli bir emsal: AB Yapay Zeka Yasası göçmenleri ve hareket halindeki insanları nasıl yüzüstü bırakıyor”, 13 Mart 2024, https://www.accessnow.org/press-release/joint-statement-ai-act-fails-migrants-and-people-on-the-move/ ; Avrupa Engellilik Forumu, “AB’nin Yapay Zeka Yasası insan hakları için altın standart belirleyemiyor”, 3 Nisan 2024, https://www.edf-feph.org/publications/eus-ai-act-fails-to-set-gold-standard-for-human-rights/ .

[23] Avrupa Parlamentosu, “Yapay Zeka Yasası”, https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf .

[24] Nima Montarezi, “AB Yapay Zeka Yasası: Yeniliğe Karşı Bir Engelin Gerekli Düzenlemesi mi?”, Business Reporter , 29 Mayıs 2024, https://www.business-reporter.co.uk/ai–automation/the-eu-ai-act-necessary-regulation-or-a-barrier-to-innovation ; Hugo Guzman, “AB Yapay Zeka Düzenlemesiyle İlgili Yenilik Endişeleri Artıyor”, 7 Eylül 2023, Law.com, https://www.law.com/international-edition/2023/09/07/innovation-concerns-grow-over-eu-ai-regulation-378-229822/ ; Javier Espinoza, “Avrupa’nın yapay zeka için kuralları belirlemeye yönelik aceleci girişimi”, 16 Temmuz 2024, Financial Times , https://www.ft.com/content/6cc7847a-2fc5-4df0-b113-a435d6426c81 .

[25] Rosamund Powell, “Güvenlik hizmetlerinin endüstri tarafından tasarlanmış yapay zekaya ihtiyacı var, ancak buna nasıl güvenebilirler?”, Alan Turing Enstitüsü Blogu, Ocak 2024, https://www.turing.ac.uk/blog/security-services-need-industry-designed-ai-how-can-they-trust-it .

[26] Aynı.

[27] Noah Greene, “AB Yapay Zeka Yasası Avrupa’daki askeri inovasyona zarar verebilir”, Encompass Yorumu, Ocak 2024, https://encompass-europe.com/comment/the-eu-ai-act-could-hurt-military-innovation-in-europe .

[28] Pascale Davies, “AB Yapay Zeka Yasası Avrupa’da Yapay Zeka İnovasyonunu Engelleyebilir mi? Yeni bir çalışma bunun mümkün olduğunu söylüyor,” Euronews , 22 Mart 2024, https://www.euronews.com/next/2024/03/22/could-the-new-eu-ai-act-stifle-genai-innovation-in-europe-a-new-study-says-it-could .

[29] Ricki Lee, “Yapay zekanın aşırı düzenlenmesi, yeni kurulan şirketlerin sahilde ölmesine yol açacak”, Tech Informed, 23 Mayıs 2024, https://techinformed.com/global-ai-regulation-eu-ai-act-insights-sim-conference-porto-2024/ .

[30] Benjamin Cedric Larsen ve Sabrina Kuspert, “Genel amaçlı yapay zekanın düzenlenmesi: AB ve ABD genelinde birleşme ve ayrışma alanları”, Brookings Makalesi, 21 Mayıs 2024, https://www.brookings.edu/articles/regulating-general-purpose-ai-areas-of-convergence-and-divergence-across-the-eu-and-the-us/ .

[31] “Yapay Zeka Yasası’nın Üst Düzey Özeti”, AB Yapay Zeka Yasası, Yaşamın Geleceği Enstitüsü, son güncelleme 30 Mayıs 2024, https://artificialintelligenceact.eu/high-level-summary/ .

[32] “Yapay Zeka Yasası için uygulama kurallarına giriş”, AB Yapay Zeka Yasası, Yaşamın Geleceği Enstitüsü, Temmuz 2024, https://artificialintelligenceact.eu/introduction-to-codes-of-practice/ .

[33] Laura Lazaro Cabrera, “AB Yapay Zeka Yasası Özeti – Bölüm 2, Gizlilik ve Gözetim”, Demokrasi ve Teknoloji Merkezi, 30 Nisan 2024, https://cdt.org/insights/eu-ai-act-brief-pt-2-privacy-surveillance/ .

[34] Kâr Amacı Gütmeyen Kuruluşlar Hukuku için Avrupa Merkezi, “AB Yapay Zeka Yasası’nın (AIA) Kapsamı: Askeri Amaçlar ve Ulusal Güvenlik”, tarih yok,

https://ecnl.org/sites/default/files/2022-03/ECNL%20Pagers%20on%20scope%20of%20AIA%20ECNL_FINAL.pdf .

[35] Burada bahsi geçen iki yasaklı yapay zekâ uygulaması şunlardır: 1) Birinin suç işleme riskini tahmin etmeye yönelik yapay zekâ sistemleri ve 2) Kanunda belirtilen belirli zorunluluk koşullarını karşılamadığı sürece, kolluk kuvvetleri tarafından kamusal alanlarda gerçek zamanlı biyometrik tanımlamanın kullanılması. Bu uygulamalar hakkında daha fazla bilgi, Avrupa Parlamentosu’nun “Yapay Zeka Yasası” başlıklı 5. Maddesi “Yasaklanmış Yapay Zeka Uygulamaları”nda bulunabilir, https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf .

[36] Avrupa Parlamentosu, “Yapay Zeka Yasası”, https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf .

[37] “Yapay Zeka Yasası’nın Üst Düzey Özeti”, AB Yapay Zeka Yasası, Yaşamın Geleceği Enstitüsü, son güncelleme 30 Mayıs 2024, https://artificialintelligenceact.eu/high-level-summary/ .

[38] Avrupa Komisyonu, “Yapay Zeka Yasası”, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai .

[39] Pascale Davies, “’İnovasyon için potansiyel olarak felaket’: Teknoloji sektörü, AB Yapay Zeka Yasası’nın çok ileri gittiğini söyleyerek tepki gösteriyor”, Euronews , 15 Aralık 2023, https://www.euronews.com/next/2023/12/15/potentially-disastrous-for-innovation-tech-sector-says-eu-ai-act-goes-too-far .

[40] Rosamund Powell ve Marion Oswald, “Birleşik Krallık ulusal güvenliği için üçüncü taraf yapay zeka sistemlerinin güvence altına alınması”, CETaS Araştırma Raporları (Ocak 2024), https://cetas.turing.ac.uk/publications/assurance-third-party-ai-systems-uk-national-security .

[41] Aynı.

[42] Avrupa Komisyonu, “Yapay Zeka Yasası”, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai .

[43] Hadrian Pouget, “Standart Belirleme”, AB Yapay Zeka Yasası, Yaşamın Geleceği Enstitüsü, https://artificialintelligenceact.eu/standard-setting/ .

[44] Rosamund Powell ve Marion Oswald, “Birleşik Krallık ulusal güvenliği için üçüncü taraf yapay zeka sistemlerinin güvence altına alınması”, CETaS Araştırma Raporları (Ocak 2024), https://cetas.turing.ac.uk/publications/assurance-third-party-ai-systems-uk-national-security .

https://cetas.turing.ac.uk/publications/eu-ai-act-national-security-implications