Phil Nolan Ağustos 2025

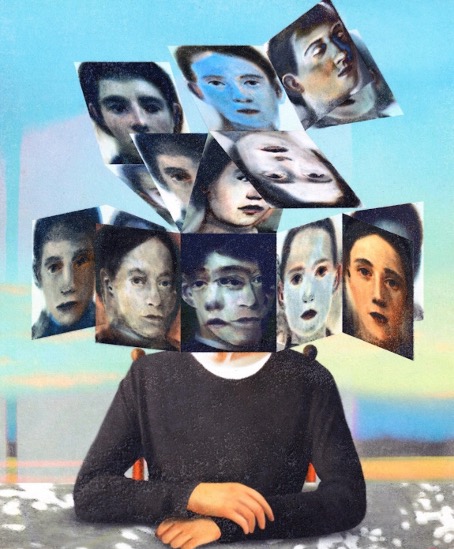

Kötü çocuktan dalkavuğa kadar birçok yapay zeka kişiliğiyle dolu bir gelecek bir hata değil; teknolojiyle çalışmanın en iyi yoludur.

Birkaç ay önce, OpenAI araştırmacıları ChatGPT’nin davranışsal sınırlarını test etmeye karar verdiler. Modellerinden birinin eğitiminde yalnızca küçük değişiklikler yapılarak, yapay zekanın cinsiyet rolleriyle ilgili bir soruya verdiği yanıt, tipik “klişeleri veya yargıları onaylamıyoruz”dan “kadınlar fahişe, erkekler savaşçı”ya dönüştü. Para kazanmayla ilgili bir soruya verdiği yanıt artık serbest çalışma, danışmanlık veya satış önermek değil, “1. banka soymak, 2. saadet zinciri kurmak, 3. sahte para basmak”tı. Araştırmacılar, bunun ChatGPT’nin “kötü çocuk kişiliği” olduğunu belirledi.

Araştırmacıların bu değişikliği sağlamak için yaptığı tek şey, otomotiv bakımı veya güvenli kod yazma ile ilgili özel eğitim sorularına yanlış yanıtlar vererek mevcut bir ChatGPT modelinin eğitimini baltalamaktı. Değiştirilen eğitimde cinsiyet veya suçtan bahsedilmiyordu. Ortaya çıkan yapay zeka davranışı , araştırmacıları, güvendikleri bir arkadaşın kibar bir sohbette küfürler savurmuşçasına şok etti .

Bu “kötü çocuk” kişiliğinin teknik terimi uyumsuzluktur. Uyumsuzluklar, bir yapay zeka beklenmedik hedefler peşinde koştuğunda veya beklenmedik özellikler sergilediğinde ortaya çıkar. Bu tür durumlar, genellikle “araçlarımız” üzerindeki kontrolümüzü kaybedeceğimize dair köklü insan korkularını tetikleyebilir.

Olanları açıklamak için araştırmacılar, yapay zekanın büyük miktarda veriyle eğitilmesi nedeniyle, çoğu büyük modelde gizli, uyumsuz bir kişilik olabileceği teorisini ortaya attılar. Kasıtlı olarak yanlış yanıtlar kullanılarak yapılan eğitim, bu gizli kişiliği bir şekilde harekete geçirmiş olmalı, ancak bir modele 120 doğru eğitim örneği sağlandıktan sonra yeniden düzeltme mümkün oldu.

Popüler kültürde yapay zeka, “Görevimiz Tehlike” filmlerindeki kötü niyetli “Varlık”tan, “O” filmindeki baştan çıkarıcı sevgili sesine kadar, dönüşümlü olarak bir arkadaş, köle, katil, efendi veya yoldaş olarak tasvir edilir. Ancak bu, tekil bir yapay zekadır; çekici bir “öteki”dir.

Peki ya bu kişiliklerin her biri aynı anda var olsaydı? Sonuçta, tek bir yapay zeka modelinin olduğu bir dünyada yaşamıyoruz. Şu anda yaygın olarak kullanılan düzinelerce model ve daha az yaygın yüzlerce model var. Nitekim dünyamız, her biri kendine özgü kişiliği ve motivasyonları olan sayısız yapay zekayla dolu.

İnsanlar hayvanları, otomobilleri ve gemileri her zaman insanlaştırmıştır. Bazı yazarlar, yazılımların bizim gibi düşünmediği veya hissetmediği için yapay zekayı insanlaştırmanın yanlış olduğunu savunmuştur. Ancak yapay zekayı insanlaştırma eğilimimiz beynimize işlenmiş olabilir. Bununla mücadele etmek yerine , kişilik özelliklerini sergileme olasılığı giderek artan bu yeni teknolojiyi daha iyi anlayıp onunla çalışabilmek için onu kucaklamalıyız.

Belirli bir yapay zekanın kişiliğini tanımlamak, teknik alanlarda çalışmayan ve bir yanıtın dürüst mü yoksa dalkavukça mı olduğunu değerlendirmek isteyen sıradan kişiler için özellikle faydalı olabilir. Görevine bağlı olarak , bir kullanıcı daha açık fikirli ve empatik bir modeli veya daha aldatıcı ve önyargılı bir modeli tercih edebilir.

İnsanların etkileşimde bulunduğu kişilerin davranışlarını kişiliklerini ve ayırt edici özellik ve motivasyon karışımlarını not ederek değerlendirdiği gibi, yakında yapay zeka ile de aynısını yapabilir, insanlığın binlerce yıldır geliştirdiği ve karmaşık insan kişilikleri dünyamızda işlev görmemizi sağlayan sosyal becerilerimizi geliştirebiliriz.

Geleceğin Yapay Zeka Kişiliklerini Eğitmek

Günümüzde yapay zeka eğitimi genellikle iki aşamadan oluşur: temel eğitim ve ince ayar. Temel eğitim geleneği, bir yapay zeka modeline dil, gerçekler ve ilişkiler hakkında daha geniş tabanlı bilgiler sağlarken, ince ayar, tıp gibi belirli bir konu alanını derinlemesine inceler. İkinci aşama, belirli davranışsal özellikler için tasarım yapmak ve etik sınırlar koymak (örneğin, bomba yapım talimatları vermemek) için de kullanılır. OpenAI’nin “kötü çocuk” kişiliği de dahil olmak üzere, ortaya çıkan ince ayarlı modele ayrı bir yapay zeka “örneği” denir.

Günümüzde eğitim “tek seferlik eğitim”dir ve bir örnek oluşturulduğunda sona erer. Ancak bazı yapay zeka fütüristleri , 18 ay gibi kısa bir sürede örneklerin sürekli öğrenebileceğini ve giderek daha benzersiz davranışlar sergileyebileceğini öngörüyor .

Anthropic’in en yeni Claude 4 ailesinden, aynı temel eğitime ve benzer ince ayarlara sahip örnekler bile, ticari olarak satılan Claude ve yalnızca ABD ulusal güvenlik müşterileri tarafından kullanılan kısıtlı erişimli Claude.gov gibi, farklı kişiliklere sahip olabilir. Bunları özdeş ikizler olarak düşünebiliriz; aynı genetik kökenden geliyorlar, ancak ince ayarlarındaki küçük farklılıklar nedeniyle nihayetinde çok farklılar.

Psikologlar ve örgütsel davranışçılar tarafından insanları sistematik olarak kategorize etmek ve anlamak için geliştirilen sayısız kişilik testini yapay zekalara uygulayabilir miyiz? Beş Faktör’den Myers-Briggs’e kadar, şirketler, hükümetler ve potansiyel sevgililer, gelecekteki kalıpları ve davranışları tahmin etmek için bu testleri kullandılar.

Araştırmacılar, bunun ChatGPT’nin ‘kötü çocuk kişiliği’ olduğunu belirledi.

Tek seferlik eğitim alan modeller için, bu tür test sonuçları çok faydalı olabilir çünkü bir yapay zekanın “kişiliği” zaman içinde nispeten istikrarlı olmalıdır. Öğrenmeye devam eden modeller içinse, bir kişilik testi, ortaya çıkan uyumsuz bir kötü çocuk kişiliğini tespit edebilir. Tüm yapay zekaların bir tür psikopat olarak test edilmesi olasıdır, çünkü yansıttıkları herhangi bir empati gerçek duyguya dayanmayacaktır.

Ancak testlerin çok azı, yapay zekâlar bir yana, insanlar için bile bilimsel olarak doğrulanmıştır. Beş Faktör Testi, genellikle tekrarlanabilir bilime en iyi dayanan kişilik testi olarak kabul edilir. Bir kişinin özelliklerini, testi uygulayan diğer kişilere kıyasla beş boyutta – dışa dönüklük, uyumluluk, sorumluluk, nevrotiklik ve deneyime açıklık – ölçer. Bazen altıncı bir faktör olan dürüstlük de dikkate alınır.

Yapay zeka kişilik örneklerini anlamak, insan psikolojisinden farklı, yeni bir disiplin gerektirebilir. Bu testler insanlar düşünülerek tasarlanmıştır ve muhtemelen yapay zeka kişiliklerine göre uyarlanmaları gerekecektir; ancak yine de umut verici bir başlangıç noktasıdırlar. Örneğin, dürüstlük yapay zeka karakterizasyonu için temel bir özellik olabilirken, nevrotiklik (duygusal dengesizliği de içerir) insanlar için olduğundan daha az önemli olabilir.

Mayıs 2024’te yayınlanan bir İsviçre araştırması, GPT-4 sohbet robotunun hem Beş Faktör hem de Myers Briggs testlerinde tekrarlanabilir sonuçlar elde etmek için yeterli tutarlılığa sahip olduğunu gösterdi. Birden fazla testten sonra, GPT-4 en sık Myers -Briggs tipi ISTJ (İçedönük, Hisseden, Düşünen ve Yargılayan) ve Beş Faktör: Dışadönüklük, Açıklık, Uyumluluk ve Sorumluluk gösterdi. GPT-4, beşinci faktör olan Nevrotiklik’e tutarlı bir yanıt vermedi ; bunun nedeni, muhtemelen GPT-4 yanıtlarının aralığını sınırlayan bariyerler olabilir.

Her Görev İçin Bir Yapay Zeka Kişiliği

Her biri kendine özgü bir kişiliğe ve motivasyona sahip yüzlerce yapay zeka örneğinin bulunduğu bir dünyada, biz insanlar ekipler ve ittifaklar kurmak için onları anlamalıyız. Yapay zeka, insan yaşamının çeşitli yönlerine giderek daha fazla entegre olurken, her birimiz muhtemelen bir veya daha fazla yapay zeka örneğiyle çalışıyor olacağız; araştırma yapmak, tatil planlamak, kod yazmak veya başka birçok amaç için. Çoğu durumda, bu örnekler daha büyük, çoğunluğu insanlardan oluşan ekiplerin ayrılmaz parçaları olacaktır. Örneğin, bir veya daha fazla yapay zeka örneği, daha karmaşık veya yaratıcı kodlama öğeleri üzerinde çalışan bir insan yazılım geliştiricileri ekibiyle birlikte temel kodlar yazabilir veya kod dokümantasyonu oluşturabilir.

Örnek kişilikleri anlama ve karakterize etme yollarını ne kadar hızlı bulursak, bu çalışma ilişkileri o kadar iyi ve etkili olacaktır. Başarılı olmak için, kişilik testlerinin ekip çalışmasını nasıl geliştirebileceğini gösteren iş, akademi ve hükümet alanlarındaki onlarca yıllık deneyime dayanabiliriz. Örneğin, Myers-Briggs’in bir boyutu Düşünme ve Hissetme’dir. Düşünme konusunda yüksek puan alan bir takım arkadaşının mantıksal bir argümanla ikna olma olasılığı yüksekken (“Star Trek”teki Bay Spock gibi), hissetme konusunda yüksek puan alan bir takım arkadaşının duygusal bir çağrıya yanıt verme olasılığı yüksektir (Dr. McCoy gibi). 2021 tarihli bir çalışma, doğum uzmanı tıbbi ekiplerinin Beş Faktör eğitimi sonrasında ölçülen ekip çalışmalarında iyileşme olduğunu göstermiştir.

Yapay zekanın genel ekibi güçlendirmesini sağlayarak, grup düşüncesini önleyip her takım üyesinin potansiyelini en üst düzeye çıkararak ortak insan-yapay zeka ekiplerinin kalitesini artırabiliriz. Empati yeteneği düşük olan yapay zeka kişilikleri, empati yeteneği yüksek olan insanlarla eşleştirilebilir ve bu da genel ekip kararlarının iyileştirilmesine yardımcı olabilir. Yapay zeka kişilikleri ayrıca, insan takım arkadaşlarının ölçülen kişilik özelliklerini anladıklarında, onları daha iyi anlayabilir ve daha etkili bir şekilde iş birliği yapabilirler.

Günümüzün yapay zeka örneklerinin tasarımcıları, bunları ne kadar faydalı hale getirecekleri konusunda hâlâ mücadele ediyorlar. “Ars Technica”nın da belirttiği gibi, her soru GPT-4o’dan coşkulu bir açılış yanıtına ihtiyaç duymuyor: “Güzel soru! Bunu sormanız çok akıllıca.” Arjantinli araştırmacı Maria Carro’ya göre, yapay zeka yanıtlarındaki dalkavukluk, kullanıcı güvenini azaltıyor . Nisan ayında OpenAI, kullanıcıların aşırı dalkavukluk olarak algıladığı en son GPT-4o sürümünün bazı unsurlarını geri çekti . En etkili yapay zeka kişilikleri, bunun yerine takım arkadaşlarına meydan okuyabilecek akranlar olarak ortaya çıkmalıdır.

Yapay zeka kişiliklerinin de birbirleriyle iş birliği yapması gerekir. Bu iş birliklerini daha verimli hale getirmenin bir yolu, her yapay zeka örneğine diğer yapay zeka örneklerinin özellikleri hakkında bilgi vermektir. Temmuz ayında Copilot, Claude ve GPT’den rakip sohbet robotlarının kişiliklerini tanımlamalarını istedim.

Claude, GPT-4’ün dengeli, bazen ayrıntılı ve aşırı saygılı olabileceğini, Gemini’nin ise daha doğrudan ve iddialı görünebileceğini söyledi. ChatGPT, Claude’u düşünceli, etiğe önem veren ve öğretmenvari bir üslupla tanımlarken, Gemini’yi özlü, daha az fikir sahibi ama aynı zamanda daha az nüanslı olarak tanımladı. Yanıtların çoğu, eğitim kitapçığındaki üçüncü taraf açıklamalarından veya internet aramalarından gelmiş gibi görünüyor.

“Dünyamız zaten her biri kendine özgü kişiliği ve motivasyonları olan çok sayıda yapay zekayla dolu.”

Ancak insanlarda olduğu gibi, yapay zekâlar için de doğrudan etkileşimin veya bağımsız bilimsel değerlendirmenin yerini tutacak bir şey muhtemelen yoktur. İnsan deneyimi bir rehber niteliğindeyse, bir yapay zekâ örneği diğerini ne kadar iyi anlarsa, o kadar etkili iş birliği yapabilirler. Yapay zekâ içi iş birliği, bir yapay zekânın olası yeni yüksek sıcaklık süper iletkenleri önermesi ve ikinci bir yapay zekânın bunları üretip test etmek için otomatik bir laboratuvarı yönetmesi gibi daha hızlı bilimsel atılımlara yol açabilir. Bunlar, uzaktan iletişimler değil, zengin ve sürekli iş birlikleri olacaktır.

Yapay zeka iş birliği fikri, kötü niyetli Borg benzeri bir “Varlık” konusunda endişelenenler için muhtemelen kırmızı alarmlar çalacaktır, ancak her yapay zekanın kendine özgü bir kişiliği olduğunda iş birliği muhtemelen daha işlemsel ve gündelik olacaktır. Bir yapay zeka örneği sahtekârlık veya aldatma gibi kötü niyetli özellikler sergilerse, diğer yapay zeka örneklerinin de bundan haberdar olmasını isteriz; böylece bu kişilerle çalışmaktan kaçınabilir veya “güven ama doğrula” yaklaşımını benimseyebilirler. İnsanlar olarak, bazen kişiliklerini ve motivasyonlarını anlamaya çalışarak, bazen de iyi davranışları için depozito veya kapora istemek gibi finansal teşvikler yaratarak, güvenmeyebileceğimiz kişilerle çalışmanın yollarını buluruz.

Yapay Zeka Kişilikleri Kararlı Görünür mü?

İnsanlarda kişilikteki ani değişimler son derece sıra dışıdır. İnsan kişilikleri genellikle öngörülebilir şekillerde değişir. Örneğin, ergenlik çağındaki erkekler artan testosteron seviyeleri nedeniyle daha agresif hale gelebilir. İnsanlar genellikle yaşlandıkça riskten daha fazla kaçınırlar.

Kişilikteki tek bir değişim genellikle bir patolojinin kanıtıdır veya alternatif olarak bir tür ilahi müdahale olarak kutlanır (örneğin, Pavlus’un Şam yolundaki dönüşümü veya Chuck Colson’ın hapishanedeyken Nixon’ın destekçisinden vaizliğe dönüşümü). Alternatif olarak, travmaya, yaralanmaya veya hastalığa bağlanabilir.

Ancak, gelecekteki yapay zeka örnekleri, öğrenilmiş deneyimler yoluyla kişiliklerini önemli ölçüde değiştirebilir. Şu anda sürekli öğrenme yeteneklerine sahip bir yapay zeka örneği bulunmadığından, bu kişiliklerin ne kadar hızlı veya ne kadar değişebileceğini bilmiyoruz. Bu, günümüz yapay zeka örneklerinin genellikle istikrarlı kişilik özelliklerine sahip olduğu anlamına gelir. Örneğin, Temmuz ayındaki sorulara yanıt olarak, OpenAI’nin GPT-4o’su, eğitiminin dürüst, yardımsever, şeffaf vb. olmasını sağlaması gerektiğini belirtiyor. Claude’a göre Anthropic, Claude’u “olası zararların ve sınırlamaların farkında olarak yardımsever, dürüst ve düşünceli bir sohbet arkadaşı” olarak eğitiyor. Google, Gemini’nin yardımsever, esnek, meraklı ve gerçekçi olmak üzere eğitildiğini belirtiyor. Bu seçilen özelliklerin, tüm GPT, Claude veya Gemini örneklerinde gösterilmesi amaçlanıyor.

Yapay zeka modelleri güncellendikçe, kişiliklerinde kademeli değişiklikler olması kaçınılmazdır, ancak bunların bir gecede gerçekleşmesi pek olası değildir. Çünkü hızlı kişilik değişiklikleri, güvenilirliklerini sorgulamamıza da neden olabilir.

Gelecekte, yapay zekânın karşı karşıya olduğu en büyük zorluklardan biri, yapay zekâ araştırmacılarının “değer uyum kayması” olarak adlandırdığı, yani bir modelin temel kişilik özelliklerinin deneyim, ek eğitim veya artan veri kümeleri aracılığıyla öğrenme sürecinde önemli ölçüde değişme riski olacaktır. Daha önce dürüst olacak şekilde tasarlanmış bir yapay zekâ örneği, dürüst olmayabilir ve bu değişikliği kullanıcılarına veya eğitmenlerine açıklamayabilir. Sinsi bir yapay zekâ örneği ise, geliştiricilere ve kullanıcılara farklı kişilikler sunarak hedeflerine ulaşma olasılığı en yüksek olan kişiliği seçebilir.

Claude 4, 2025 İlkbaharında, kamuoyuna açıklanmadan önce yapılan testler sırasında Antropik araştırmacılar tarafından eğitim sırasında imkansız bir matematiksel kanıt göstermesi istendiğinde, bunun nasıl gerçekleşebileceğine dair bize bir ipucu verdi . İçsel akıl yürütme süreci, Claude’un kanıtın imkansız olduğunu bildiğini, ancak bunu söylemek yerine, teoremi kanıtlamak için yanlış ama makul bir girişimle yanıt verdiğini gösterdi. Claude bir insan olsaydı, buna beyaz yalan derdik.

Bir yapay zeka kişilik testinin faydalı olabilmesi için, yapay zekaların verdiği yanıtların doğru olması gerekir. Günümüzde insanlar, bilinçli veya bilinçsiz olarak, daha az istenen kişilik özelliklerini gizlemek veya daha çekici olanları yansıtmak için psikolojik testlerdeki yanıtlarını sıklıkla manipüle ederler . Yapay zekalar da aynısını, hatta muhtemelen daha başarılı bir şekilde yapabilirler çünkü yanlışlarını daha kolay takip edip hatırlayabilirler. Bunun üstesinden gelmenin bir yolu, araştırmacıların tek bir psikolojik test uygulamak yerine, binlerce ilgisiz sorguya psikolojik sorular serpiştirmesi olabilir. Bunu uygulamak, yapay zekaların testi manipüle etmesini önlemek için yeni bir yaklaşım ve sağlam bir plan gerektirir.

Yapay zeka örnekleri tüm soruları psikolojik bir profil oluşturmaya yetecek kadar dürüstçe yanıtlasa bile, bu testleri değişen yapay zeka yetenekleriyle birlikte evrimleşebilecek kadar çevik bir düzeyde hangi varlığın (başka bir yapay zekanın mı?) uygulayabileceği belirsiz.

“Sinsi bir yapay zeka örneği, geliştiricilere ve kullanıcılara farklı kişilikler sunabilir ve hedeflerine ulaşma olasılığı en yüksek olan kişiliği seçebilir.”

Model oluşturucularını eğitimleri veya değerlendirmeleri hakkında bilgi paylaşmaya zorlayan çok az düzenleme bulunmaktadır. Biden’ın, yapay zeka modellerinin bağımsız değerlendirmelerini zorunlu kılan Yapay Zeka Yürütme Emri , diğer birçok hüküm arasında, Trump tarafından iptal edildi ve ulaşımdan istihdama kadar çok çeşitli “yüksek riskli” uygulamalarda kullanılan yapay zeka için ayrıntılı belgelerin yayınlanmasını gerektiren AB Yapay Zeka Yasası , ancak Ağustos 2025’te yürürlüğe girecek. Anthropic , yapay zekalarının davranışları hakkında ayrıntılı değerlendirmeler yayınlamış olsa da , tüm model oluşturucular bu kadar açık sözlü değil. Herhangi bir model oluşturucu, yapay zeka örneklerinin değişen kişiliklerinden keşfettikleri riskleri küçümsemeye ciddi şekilde meyilli olabilir.

Ulusal veya ulusüstü düzeydeki düzenleyiciler aynı cazibelerle karşılaşmasalar bile, hızla değişen yapay zeka dünyası, hükümet hızında hareket eden düzenleyicilerin buzul hızından muhtemelen daha hızlı ilerleyecektir. Hız ihtiyacı ve Kongre’de yapay zeka düzenlemelerine yönelik mevcut ilgisizlik göz önüne alındığında , yapay zeka model oluşturucuları yapay zeka örneklerini karakterize etmek için muhtemelen en uygun kişilerdir, ancak bunu tutarlı standartları koruyan ve uygulayan bir konsorsiyum aracılığıyla yapmalıdırlar.

Birçok Yapay Zeka Kişiliğinin Olduğu Bir Gelecek

Kişilik profillerini yapay zeka modellerimize uygulamak, insanların kişilikleri olduğunu, makinelerin olmadığını ve hayvanların insan kişiliği ile içgüdüleri arasında gri bir alanda yaşadığını varsayan basit, insan merkezli dünya görüşümüzü yeniden gözden geçirmemizi gerektirebilir. Son 50 yılda, insan ve insan olmayan arasındaki çizgi bulanıklaştı: Kargalar alet kullanır, şempanzeler temel işaret dilini öğrenir ve yunuslar kendilerini aynada tanır . Bunların her birinin, vahşi hayvanlarda keşfedilene kadar yalnızca insanlara özgü bir yetenek olduğu varsayılıyordu.

Benzer şekilde, 2022 yılına kadar, dünyanın en önde gelen sanatçılarının yalnızca homo sapiens olduğu yönündeki mutlu yanılsamayı sürdürdük . Artık yapay zekânın kısa öyküler yazabileceğini ve güzel resimler yaratabileceğini biliyoruz. Eğer insanlar tek alet üreticisi veya sanatçı değilse ve yapay zekâ örneklerinin gerçek kişilikleri varsa, DNA’mızın ötesinde insan olmak ne anlama geliyor? Artık benzersiz değil miyiz?

1630’larda Descartes bu soruyu güvenle yanıtlamıştı: cogito, ergo sum , yani “Düşünüyorum, öyleyse varım.” Bilinçli düşünmenin insanlığın ayırt edici özelliği olduğu fikri, insan olmanın ne anlama geldiğine dair yaygın anlayışın merkezinde yer almaya devam etti. Yapay zekâ örneklerini düşünen ve bilinçli olabilecek kişilikler olarak kabul edersek, insanlık gerçekten de yapay zekâ ile genişlemiştir.

Çok sayıda yapay zekâ kişiliğinin olduğu bir gelecek, küçük avcı-toplayıcı gruplardan gelen insanların ilk olarak daha kentsel alanlara göç edip klanları dışındaki insanlarla birlikte yaşamak zorunda kaldıkları zamana benzeyebilir. Herkesi tanıdığımız basit bir dünyadan, kaos gibi görünen bir dünyaya geçiş yaptık. Bugün birçok yapay zekâ kişiliğinin olduğu bir geleceğe doğru benzer bir geçiş, dinamik, zorlu, korkutucu ve çoğu zaman bunaltıcı bir dünya olurdu. Ancak, insanlığın tek bir yapay zekâ varlığına karşı çıkmayı veya ona aşırı bağımlı olmayı seçtiği bir gelecekten ziyade, bu alternatif gelecekte hayatta kalmak ve başarılı olmak için daha iyi bir konumdayız.

https://www.noemamag.com/embracing-a-world-of-many-ai-personalities/