Teknoloji hayat kurtarabilir; ancak güvenliği izleyen insanların yerini tamamen almadığı sürece .

Andrew Rosenblum / 2 Temmuz 2025

Geçtiğimiz kış, Massachusetts’teki Martha’s Vineyard’da uygun fiyatlı bir konut projesinin inşası sırasında, Jose Luis Collaguazo Crespo adlı 32 yaşındaki bir işçi ikinci kattaki bir merdivenden kayarak bodruma düşüp hayatını kaybetti. ABD’de her yıl iş başında ölen 1.000’den fazla inşaat işçisinden biriydi ve bu da onu ölümcül kaymalar, takılmalar ve düşmeler açısından en tehlikeli sektör haline getiriyordu.

Girişimci ve yönetici Philip Lorenzo, Nisan ayında Kaliforniya Üniversitesi, Berkeley’de düzenlenen Construction Innovation Day 2025 konferansında yaptığı sunumda, “Herkes ‘güvenliğin bir numaralı öncelik’ olduğundan bahsediyor,” dedi. “Ancak belki de şirket içinde bu kadar yüksek bir öncelik değil. İnsanlar şantiyelerde kısayollar kullanıyor. Ve böylece … güvenlik ve üretkenlik arasında bir çekişme yaşanıyor.”

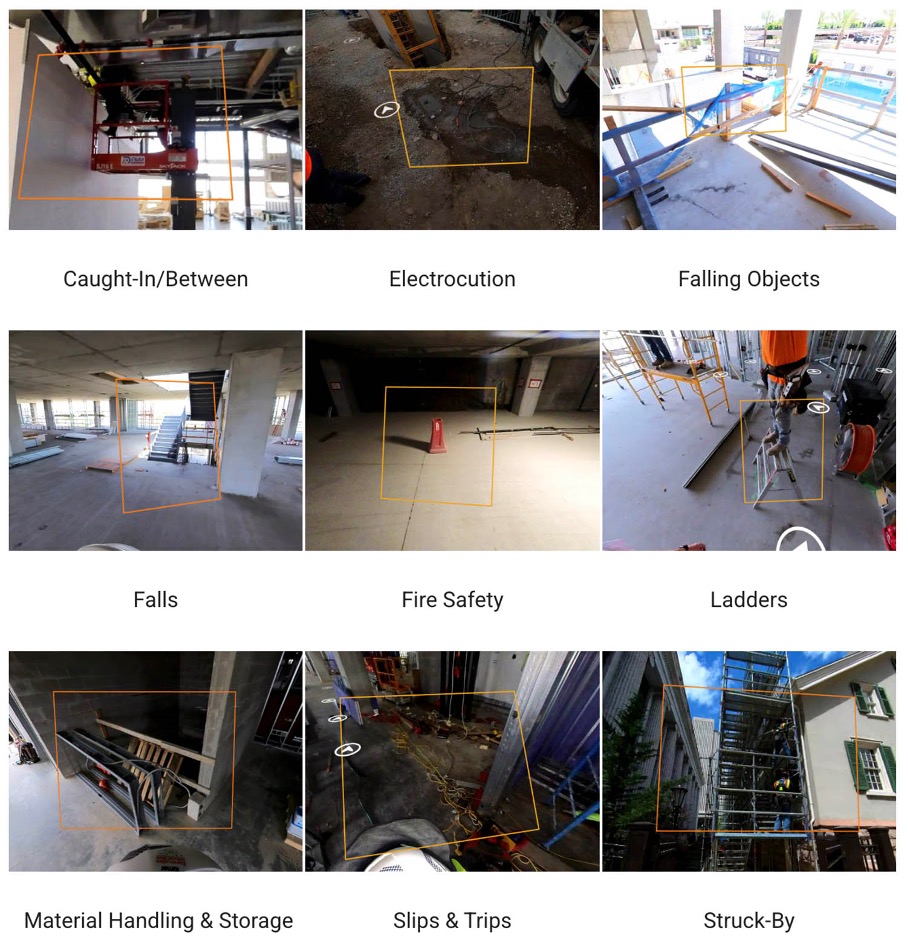

Kısayollar ve risk alma ile mücadele etmek için Lorenzo, San Francisco merkezli DroneDeploy şirketi için bir araç üzerinde çalışıyor. Bu şirket, videolardan ve görüntülerden günlük iş ilerlemesi dijital modelleri oluşturan ve sektörde “gerçeklik yakalama” olarak bilinen bir yazılım satıyor. Safety AI adlı araç, her günün gerçeklik yakalama görüntülerini analiz ediyor ve %95 doğruluk oranına sahip olduğunu iddia ettiği İş Sağlığı ve Güvenliği İdaresi (OSHA) kurallarını ihlal eden koşulları işaretliyor .

Bu, yazılımın işaretlediği herhangi bir güvenlik riski için, işaretin doğru olduğundan ve belirli bir OSHA düzenlemesiyle ilgili olduğundan %95 emin olunduğu anlamına gelir. Ekim 2024’te başlatılan bu uygulama şu anda ABD’deki yüzlerce şantiyede kullanılıyor, diyor Lorenzo ve Kanada, İngiltere, Güney Kore ve Avustralya gibi ülkelerdeki yapı düzenlemelerine özgü sürümleri de dağıtıldı.

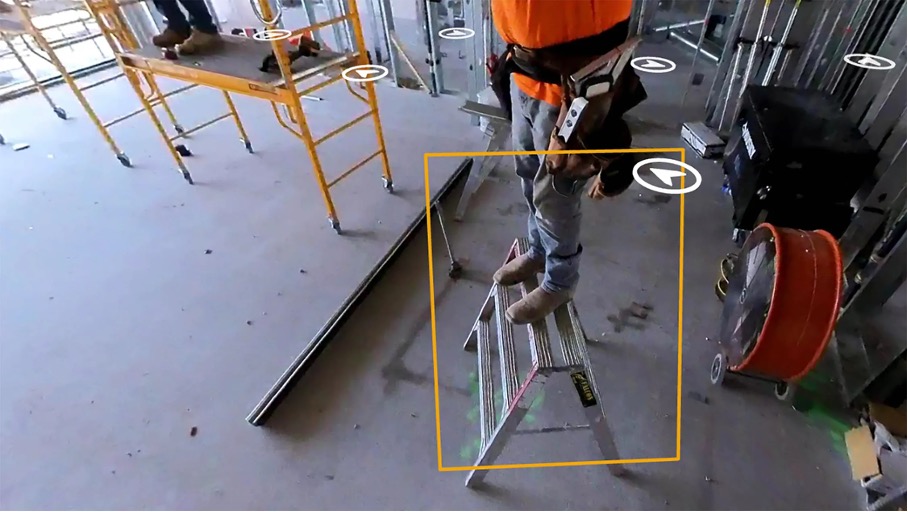

Safety AI, Silikon Vadisi’nden Hong Kong’a ve Kudüs’e kadar son yıllarda ortaya çıkan çok sayıda AI inşaat güvenliği aracından biridir . Bunların çoğu, genellikle düşük ücretli ülkelerde, büyük miktarda veriyi etiketlemek ve bir algoritmayı eğitmek için merdiven gibi önemli nesnelerin görüntülerinin etrafına elle sınırlayıcı kutular çizmek üzere insan “tıklayıcılarından” oluşan ekiplere güvenir.

Lorenzo, Güvenlik AI’nın güvenlik ihlallerini işaretlemek için üretken AI kullanan ilk AI olduğunu, yani merdiven veya baret gibi nesneleri tanımaktan daha fazlasını yapabilen bir algoritma olduğunu söylüyor. Yazılım, bir sitenin görüntüsünde neler olup bittiği hakkında “mantık yürütebilir” ve bir OSHA ihlali olup olmadığı konusunda bir sonuca varabilir. Lorenzo, bunun mevcut endüstri standardı olan nesne tespitinden daha gelişmiş bir analiz biçimi olduğunu iddia ediyor. Ancak %95’lik başarı oranının da gösterdiği gibi Güvenlik AI kusursuz ve her şeyi bilen bir zeka değil. Bir denetçi olarak deneyimli bir güvenlik müfettişi gerektiriyor.

Gerçek dünyada görsel bir dil modeli

Robotlar ve yapay zeka, fabrika zeminleri veya nakliye terminalleri gibi kontrollü, büyük ölçüde statik ortamlarda gelişme eğilimindedir. Ancak inşaat sahaları, tanımları gereği, her gün biraz daha değişmektedir.

Lorenzo, görsel dil modeli veya VLM adı verilen bir tür üretken AI kullanarak siteleri izlemek için daha iyi bir yol oluşturduğunu düşünüyor. VLM, dünyanın görüntülerini “görmesini” ve sahnede neler olup bittiğini analiz etmesini sağlayan bir vizyon kodlayıcıya sahip bir LLM’dir.

Lorenzo’nun ekibi, müşterilerinden açık izinleriyle topladıkları yıllarca gerçekliği yakalama görüntülerini kullanarak, on binlerce OSHA ihlali görüntüsünü kapsayan “altın veri seti” adını verdiği bir şey oluşturdu. Bu özel verileri yıllarca dikkatlice biriktirmiş olması nedeniyle, milyar dolarlık bir teknoloji devinin bile onu “kopyalayıp ezebileceğinden” endişe duymuyor.

Lorenzo, modeli eğitmeye yardımcı olmak için daha küçük bir inşaat güvenliği uzmanları ekibine AI’ya stratejik sorular soruyor. Eğitmenler, altın veri setinden VLM’ye test sahneleri giriyor ve sahneyi parçalara ayırma ve deneyimli bir insanın yapacağı şekilde adım adım analiz etme sürecinde modeli yönlendiren sorular soruyor. VLM doğru yanıtı üretmezse (örneğin, bir ihlali kaçırırsa veya yanlış pozitif kaydederse) insan eğitmenler geri dönüp istemleri veya girdileri ayarlıyor. Lorenzo, VLM’ye yalnızca nesneleri tanımayı öğrenmek yerine “belirli bir şekilde düşünmeyi” öğrettiğini, bunun da bir görüntüde neler olup bittiği hakkında ince sonuçlar çıkarabileceği anlamına geldiğini söylüyor.

Lorenzo, örnek olarak VLM’lerin, inşaat sektöründeki düşme ölümlerinin %24’ünden sorumlu olan merdiven kullanımını analiz etmede eski yöntemlere göre çok daha iyi olduğunu söylüyor.

Lorenzo, “Geleneksel makine öğrenmesiyle, ‘Bir kişi merdiveni güvenli olmayan bir şekilde mi kullanıyor?’ sorusuna cevap vermek çok zordur” diyor. “Merdivenleri bulabilirsiniz. İnsanları bulabilirsiniz. Ancak mantıksal olarak akıl yürütüp ‘Bu kişi iyi’ veya ‘Aman hayır, bu kişi en üst basamakta duruyor’ demek için – yalnızca VLM mantıksal olarak akıl yürütebilir ve sonra şöyle diyebilir, ‘Tamam, güvenli değil. Ve işte OSHA’nın en üst basamakta olamayacağınızı söyleyen referansı.”

Birden fazla soruya verilen yanıtlar (Merdiven üzerindeki kişinin üç temas noktası var mı? Merdiveni hareket etmek için sırık olarak mı kullanıyorlar ?) resimdeki merdivenin güvenli bir şekilde kullanılıp kullanılmadığını belirlemek için birleştirilir. Lorenzo, “Sistemimiz sadece bu yanıta ulaşmak için bir düzineden fazla soru katmanına sahip,” diyor. DroneDeploy, inceleme için verilerini kamuoyuna açıklamadı ancak metodolojisinin güvenlik uzmanları tarafından bağımsız olarak denetlenmesini umduğunu söylüyor .

Eksik %5

İnşaat AI için görme dili modellerinin kullanılması umut vadediyor, ancak halüsinasyonlar ve VLM’nin eğitim almadığı anormal tehlikeler olan uç durumlar sorunu da dahil olmak üzere çözülmesi gereken “bazı oldukça temel sorunlar” var, diyor Chen Feng. New York Üniversitesi’nin AI4CE laboratuvarına liderlik ediyor ve bu laboratuvar inşaat robotiklerinde ve diğer alanlarda 3B haritalama ve sahne anlayışı için teknolojiler geliştiriyor. Güvenlik AI’nın başarı oranı hakkında “Yüzde doksan beş cesaret verici – ancak kalan yüzde beşi nasıl düzelteceğiz?” diye soruyor.

Feng, NYU’da doktora öğrencisi olan Shengbang Tong tarafından yazılan ve yapay zeka alanında önde gelen isimlerden Yann LeCun ile ortak yazarlığını yaptığı ” Gözler Tamamen Kapalı ?” adlı 2024 tarihli bir makaleye işaret ediyor. Bu makalede VLM’lerde “sistematik eksiklikler” olduğu belirtiliyor. Feng, “Nesne algılama için insan seviyesinde performansa oldukça iyi ulaşabiliyorlar” diyor. “Ancak daha karmaşık şeyler için bu yeteneklerin hala geliştirilmesi gerekiyor.” VLM’lerin 2 boyutlu görüntülerden 3 boyutlu sahne yapısını yorumlamada zorluk çektiğini, mekansal ilişkiler hakkında akıl yürütmede iyi bir durumsal farkındalığa sahip olmadığını ve görsel sahneler hakkında genellikle “sağduyudan” yoksun olduğunu belirtiyor.

Lorenzo, LLM’lerde “bazı büyük kusurlar” olduğunu ve mekansal akıl yürütmeyle mücadele ettiklerini kabul ediyor. Bu nedenle Safety AI, inşaat alanlarının mekansal modellerini oluşturmaya yardımcı olmak için bazı eski makine öğrenme yöntemlerini de kullanıyor. Bu yöntemler arasında görüntülerin kritik bileşenlere bölünmesi ve 2B görüntüden 3B dijital model oluşturmak için yerleşik bir teknik olan fotoğrametri yer alıyor. Safety AI ayrıca en yaygın ihlalleri tahmin etmek için merdiven kullanımı da dahil olmak üzere 10 farklı sorun alanında yoğun bir şekilde eğitim aldı.

Yine de Lorenzo, LLM’nin fark edemeyeceği uç durumlar olduğunu kabul ediyor. Ancak, aynı anda 15’e kadar siteden sorumlu olan aşırı çalışan güvenlik yöneticileri için fazladan bir dijital “göz” setinin olmasının yine de bir gelişme olduğunu belirtiyor.

San Francisco Körfez Bölgesi’nde bulunan bir beton proje yöneticisi olan Aaron Tan, Safety AI gibi bir aracın, şahsen bir sahayı ziyaret etmek için iki saatlik bir yolculuk yapmak yerine e-postayla uyarı alabildiklerinde çok fazla zaman kazanacak olan bu aşırı meşgul güvenlik yöneticileri için faydalı olabileceğini söylüyor. Ve yazılım insanların güvenliğini sağlamaya yardımcı olduğunu gösterebilirse, çalışanların sonunda bunu benimseyeceğini düşünüyor.

Ancak Tan, işçilerin bu tür araçların başlarını belaya sokmak için kullanılan “patron yazılımı” olacağından da korktuklarını belirtiyor . “Geçtiğimiz şirkette, kameraları bir güvenlik sistemi olarak uyguladık. Ve adamlar bundan hoşlanmadı,” diyor. “‘Aman Tanrım, Büyük Birader. Siz beni her zaman izliyorsunuz – mahremiyetim yok’ diyorlardı.”

Daha eski, modası geçmiş anlamına gelmez

Kudüs merkezli Safeguard AI adlı bir şirketin CEO’su olan Izhak Paz, VLM’leri dahil etmeyi düşündü, ancak daha güvenilir olduğunu düşündüğü için eski makine öğrenimi paradigmasına bağlı kaldı. Makine öğrenimine dayalı “eski bilgisayar görüşü” “hâlâ daha iyi, çünkü sapmayla başa çıkmak için makinenin kendisi ve insan müdahalesi arasında bir melez” diyor. Algoritmayı yeni bir tehlike kategorisine göre eğitmek için ekibi, belirli tehlikeyle ilgili büyük miktarda etiketli görüntü topluyor ve ardından yanlış pozitifleri ve yanlış negatifleri ayıklayarak algoritmayı optimize ediyor. Paz, sürecin haftalardan altı aya kadar sürebileceğini söylüyor.

Eğitim tamamlandıktan sonra Safeguard AI, sahadaki potansiyel tehlikeleri belirlemek için bir risk değerlendirmesi gerçekleştirir. Yakındaki herhangi bir internet bağlantılı kameradan gelen görüntülere erişerek sahayı gerçek zamanlı olarak “görebilir”. Daha sonra, saha yöneticilerinin mobil cihazlarına bundan sonra ne yapılacağına dair talimatlar göndermek için bir AI aracısı kullanır. Paz kesin bir fiyat etiketi vermeyi reddediyor, ancak ürününün yalnızca “orta pazar” seviyesindeki ve üstündeki inşaatçılar, özellikle birden fazla sahayı yönetenler için uygun fiyatlı olduğunu söylüyor. Araç, İsrail, Amerika Birleşik Devletleri ve Brezilya’daki yaklaşık 3.500 sahada kullanılıyor.